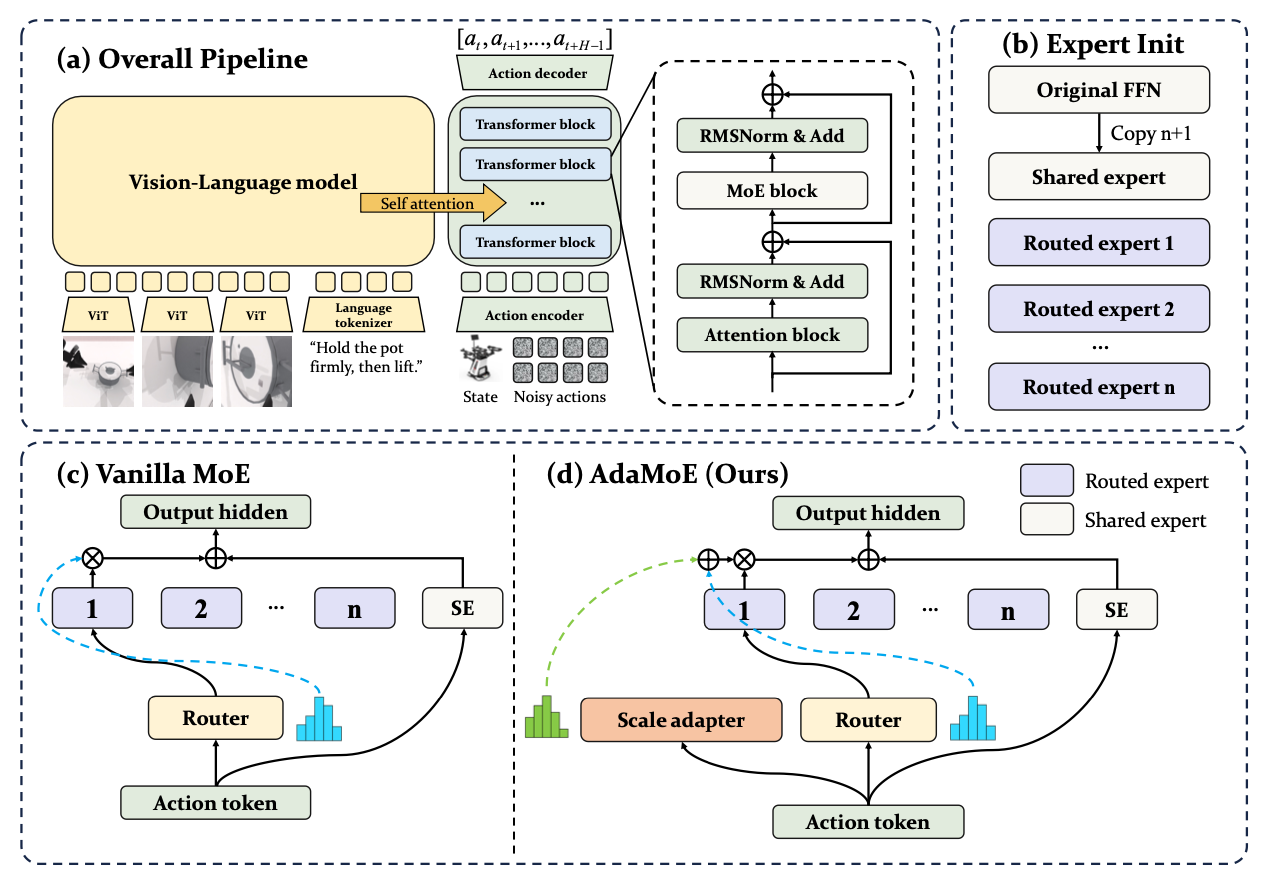

聊聊AdaMoE:让专家别“独占舞台”的 VLA 稀疏架构

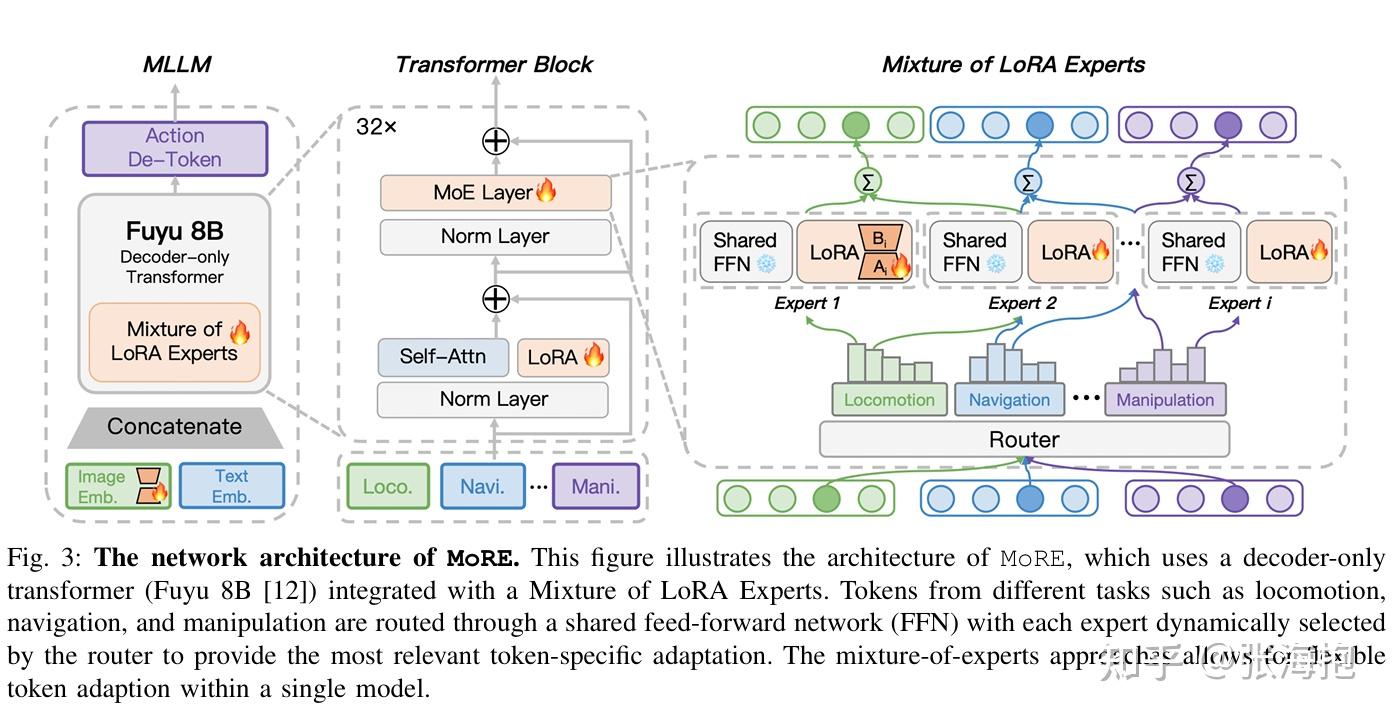

作者:小红师兄 https://zhuanlan.zhihu.com/p/1980358735869268796 今天聊聊AdaMoE(VLA),先用一句话概括一下:AdaMoE 这篇论文想解决的是「在 Vision-Language-Action (VLA) 模型里用 Mixture-of-Exp

作者:小红师兄 https://zhuanlan.zhihu.com/p/1980358735869268796 今天聊聊AdaMoE(VLA),先用一句话概括一下:AdaMoE 这篇论文想解决的是「在 Vision-Language-Action (VLA) 模型里用 Mixture-of-Exp

.jpg)

最近几个月在各种场景上做了大量的agent RL训练,例如search agent, 数据分析agent 等等。既有小的dense model,也有大的moe。有单一数据场景,有多源合板数据场景。有失败的经历,也有成功的经历。这里抽空分享下一些感悟,比较乱,随便看看就行: 1、稳定性是工业级场景下R

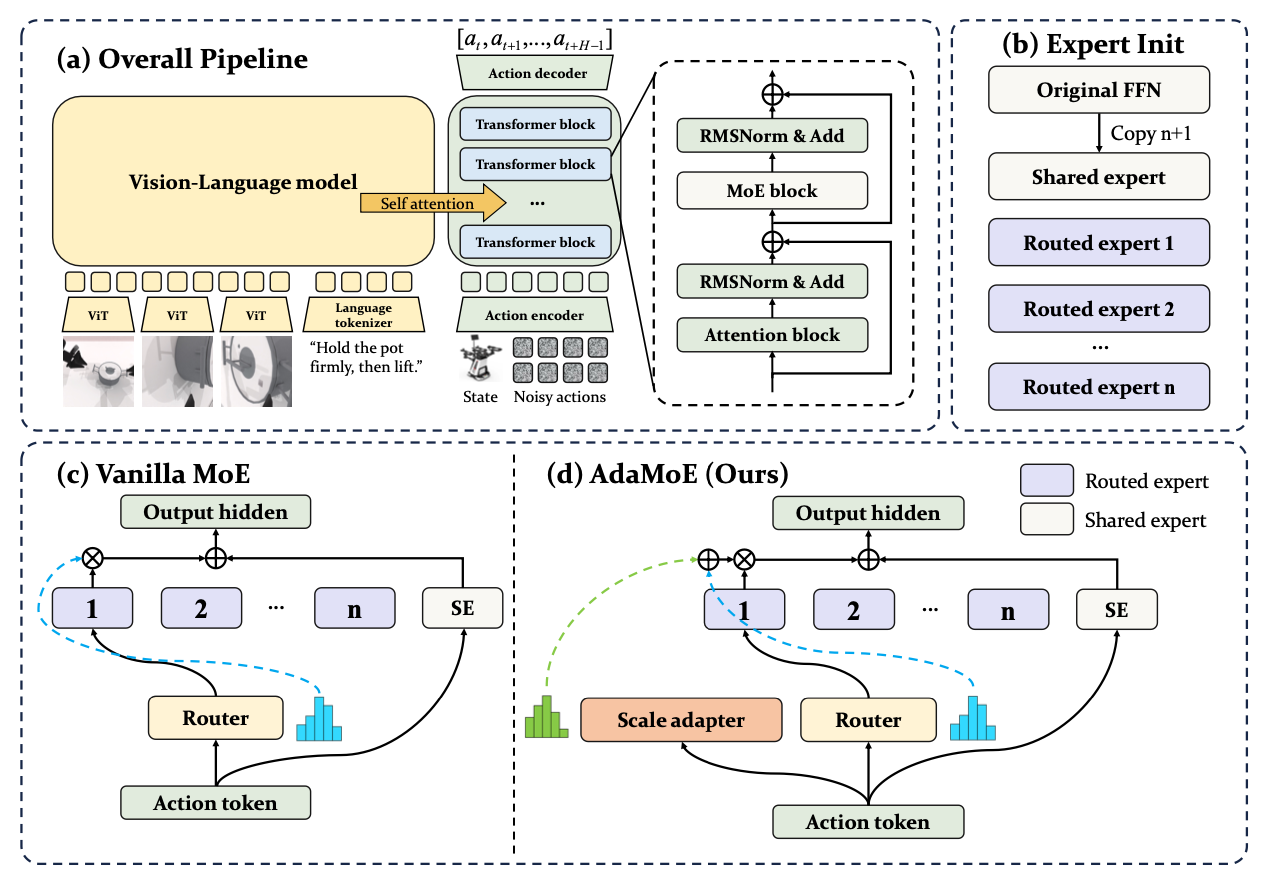

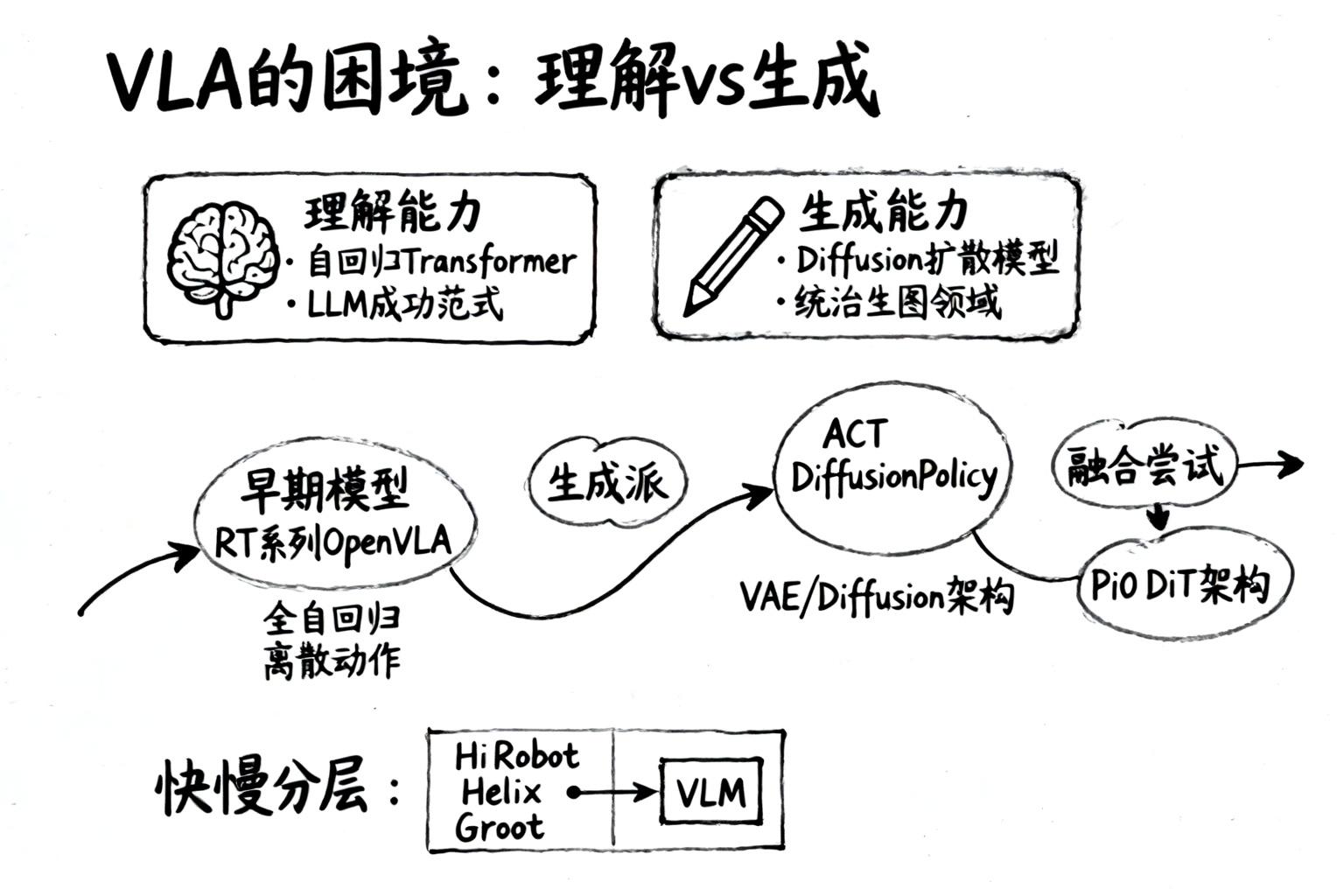

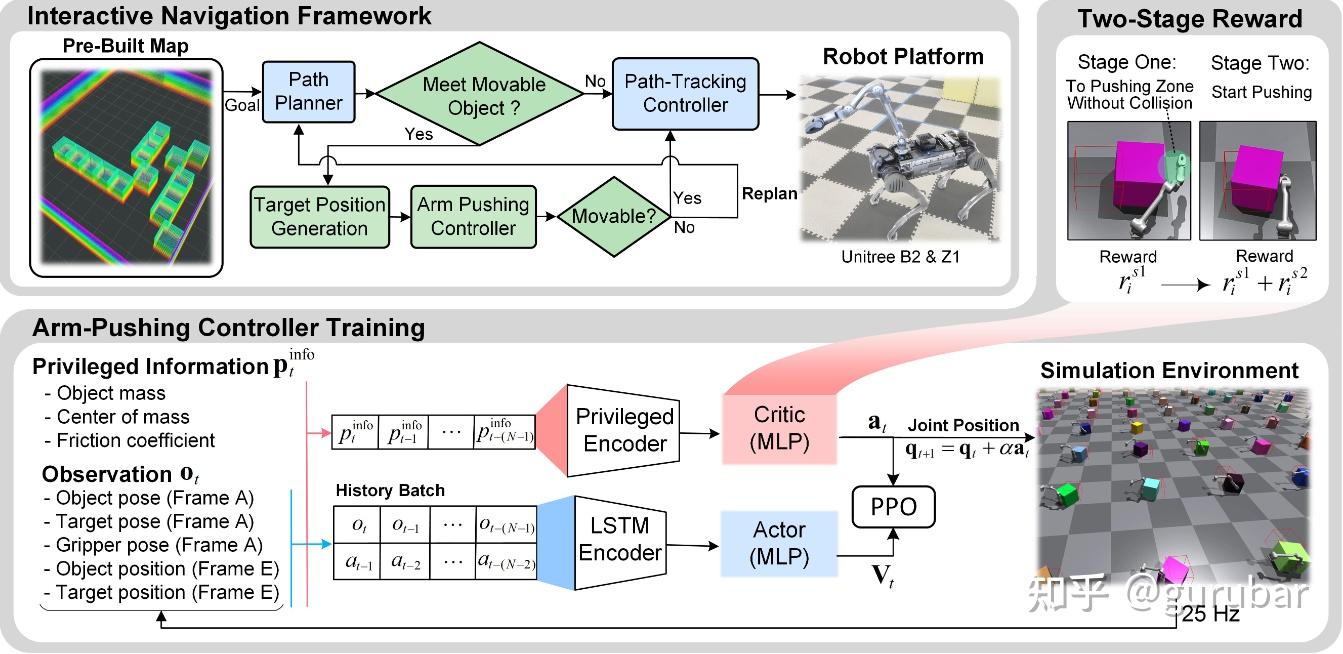

作者:小秋 https://zhuanlan.zhihu.com/p/1979682819170145066 前言 快慢双系统早已不是第一次在具身智能里被提出来了。 从 Daniel Kahneman 的《思考,快与慢》到机器人,大家都在拿 System 1 / System 2 打比方:一个负责“

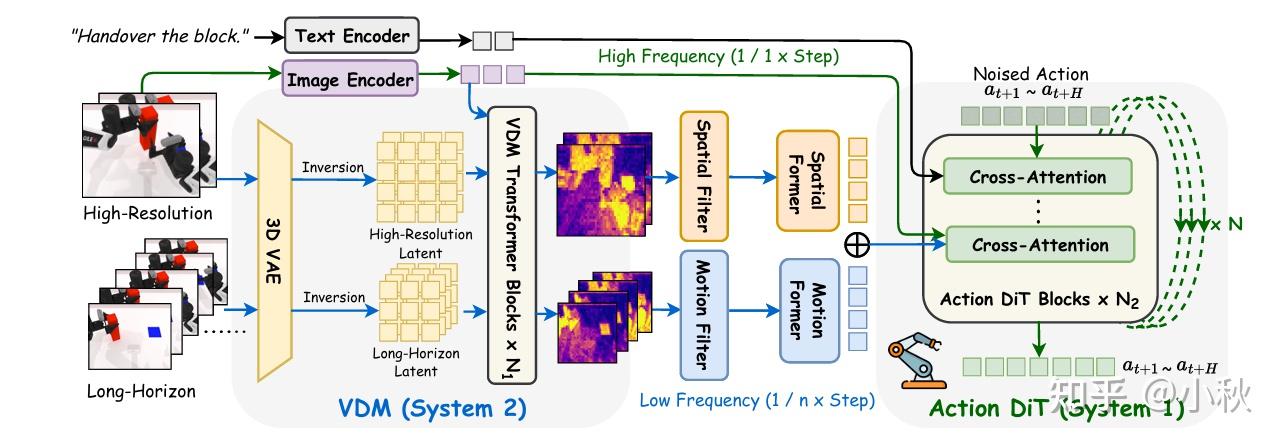

作者:骑虎南下 https://zhuanlan.zhihu.com/p/1931235792501608813 这里,分两个主要模块介绍AI模型推理引擎整体架构与主要功能。回顾AI落地的发展过程,我们可以简单地将AI模型的发展分为小模型领域与大模型领域。 在小模型领域以CNN模型为主,模型结构变化

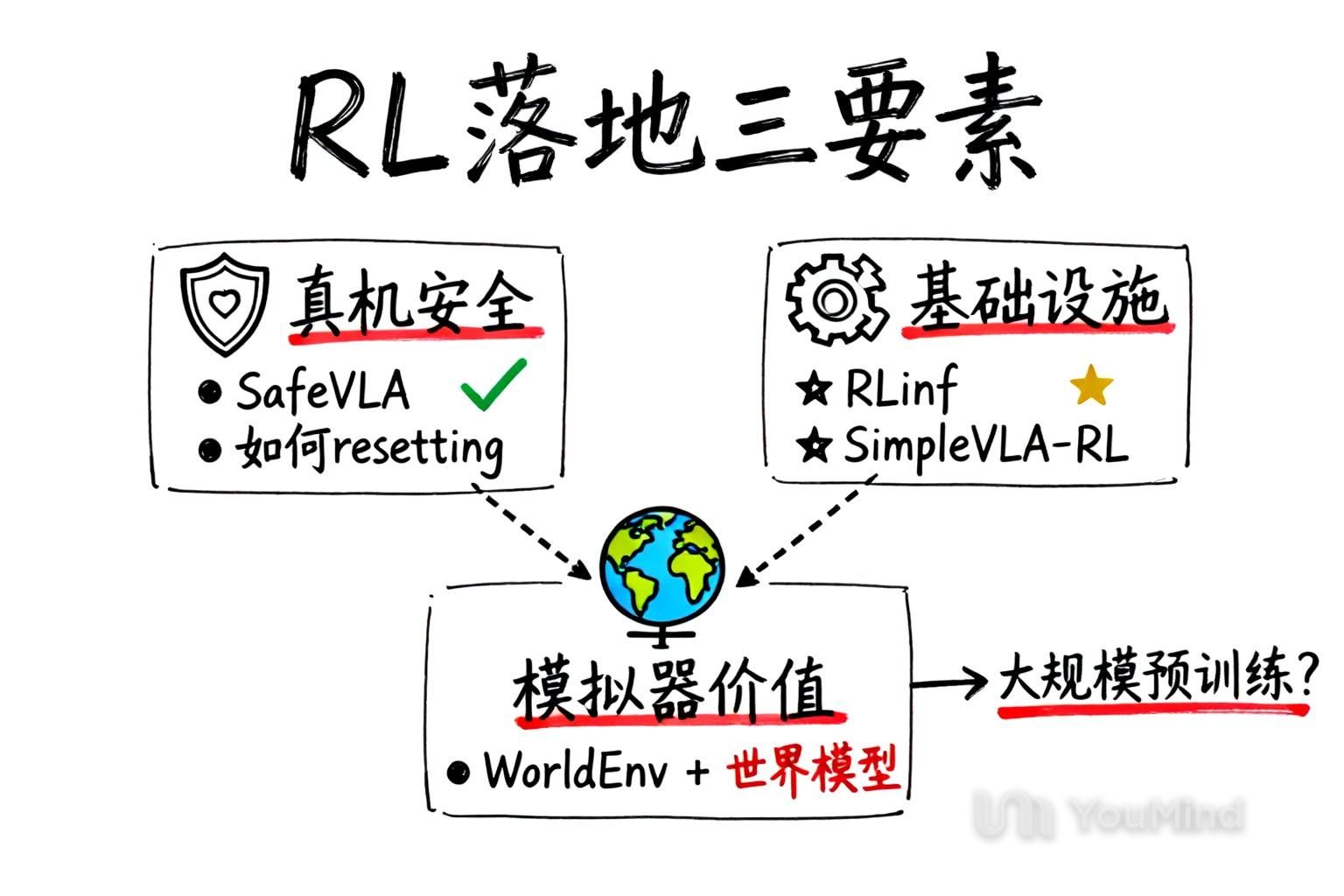

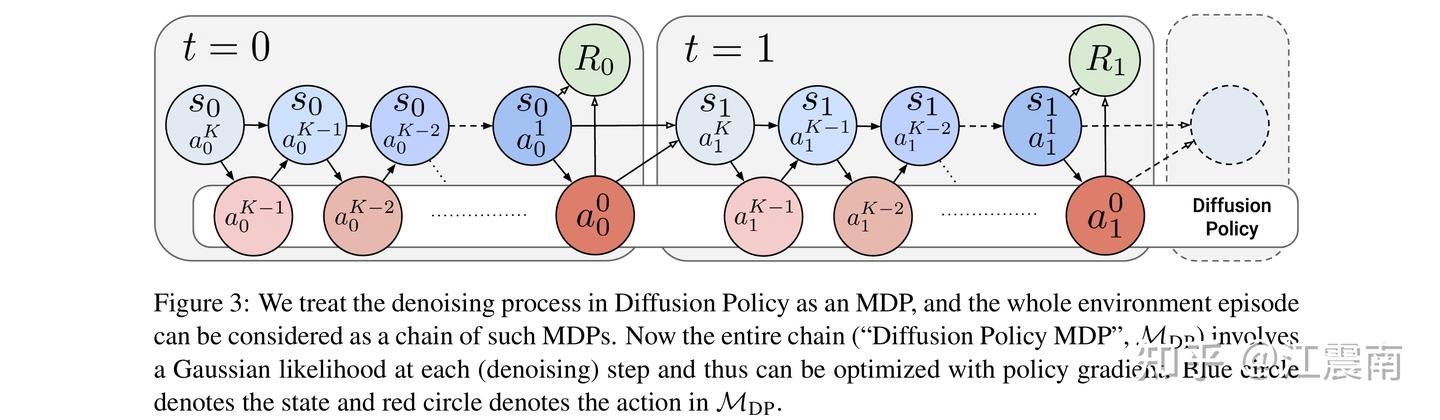

作者:张海抱 https://zhuanlan.zhihu.com/p/1976979860405633293 最近 VLA 的一大研究趋势就是不再满足于 SFT,而是也要上 RL 了。最近读了一波这方面的论文,分享一些心得。 首先,有些文献调研还是按照 online RL / offline RL

.png)

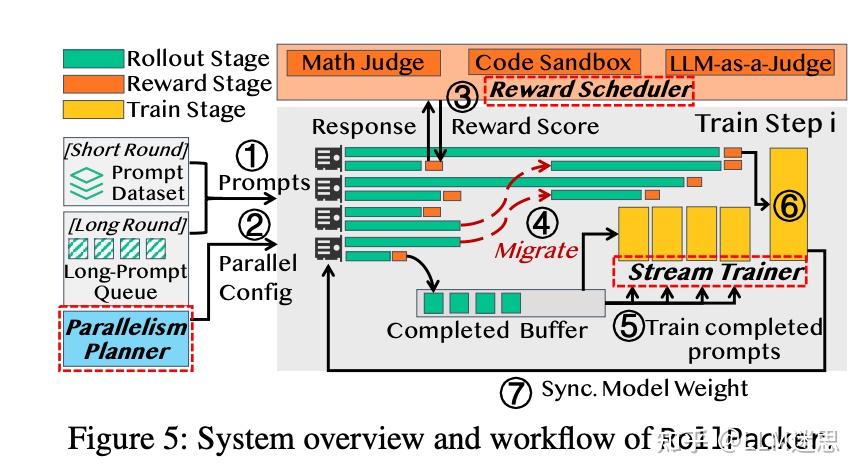

作者:东水长(已授权) https://zhuanlan.zhihu.com/p/1973206684907365344 训推不一致和异步框架 最近看到不少关于大模型强化学习中“训推不一致”和“异步训推框架”的讨论,我自己的直觉是:这些看上去复杂多样的问题,很大一部分其实都围绕着一个更基础的矛盾——

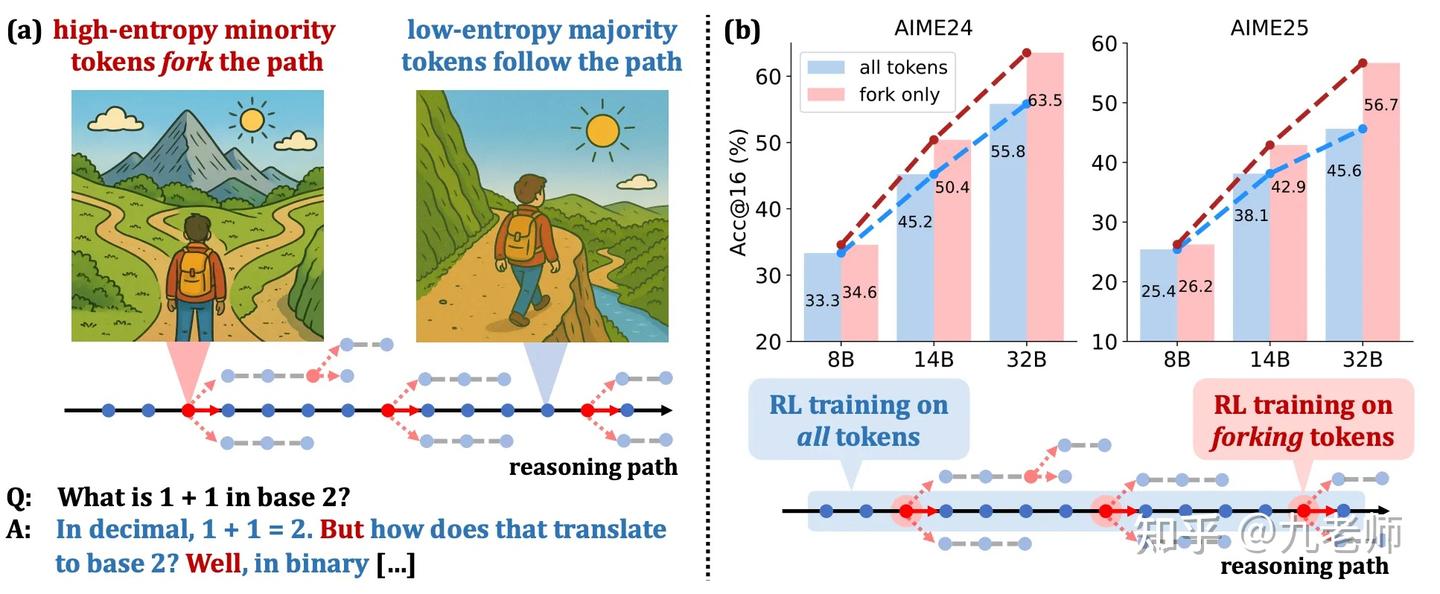

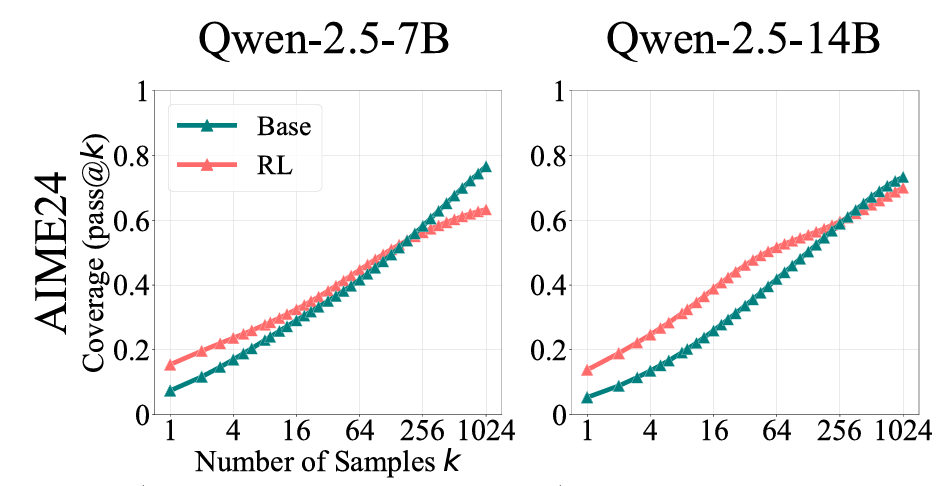

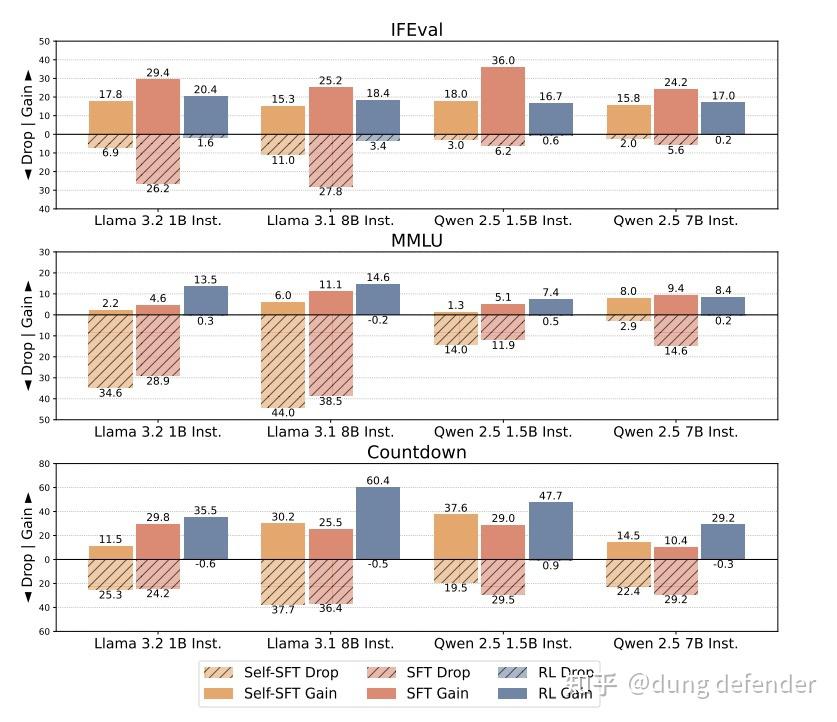

作者:九老师 https://zhuanlan.zhihu.com/p/1976336943878005134 最近陆续有了一些研究LLM中RL相比SFT更不容易造成灾难性遗忘的工作,清晰地指出是RL的On-Policy特性带来了参数的稳定,而SFT将模型参数推向与预训练分布差异很大的方向,导致了遗

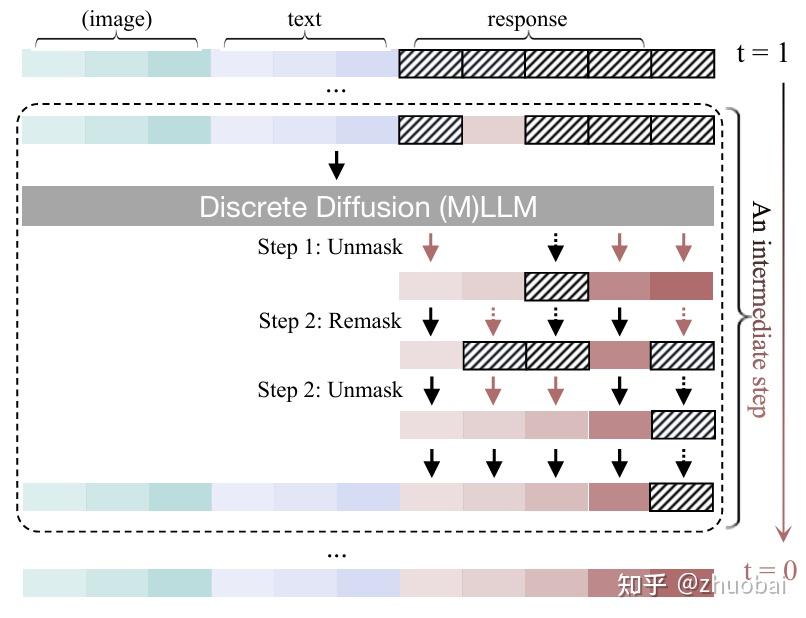

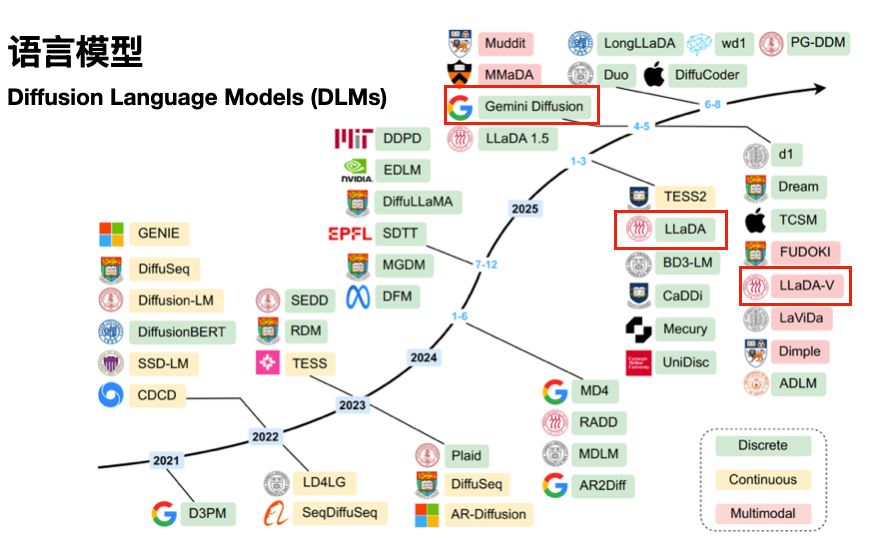

作者:zhuobai https://zhuanlan.zhihu.com/p/1935370284921263679 今天跟大家分享下前段时间阅读的来自新国立 showlab 的一篇综述: Discrete Diffusion in Large Language and Multimodal Mo

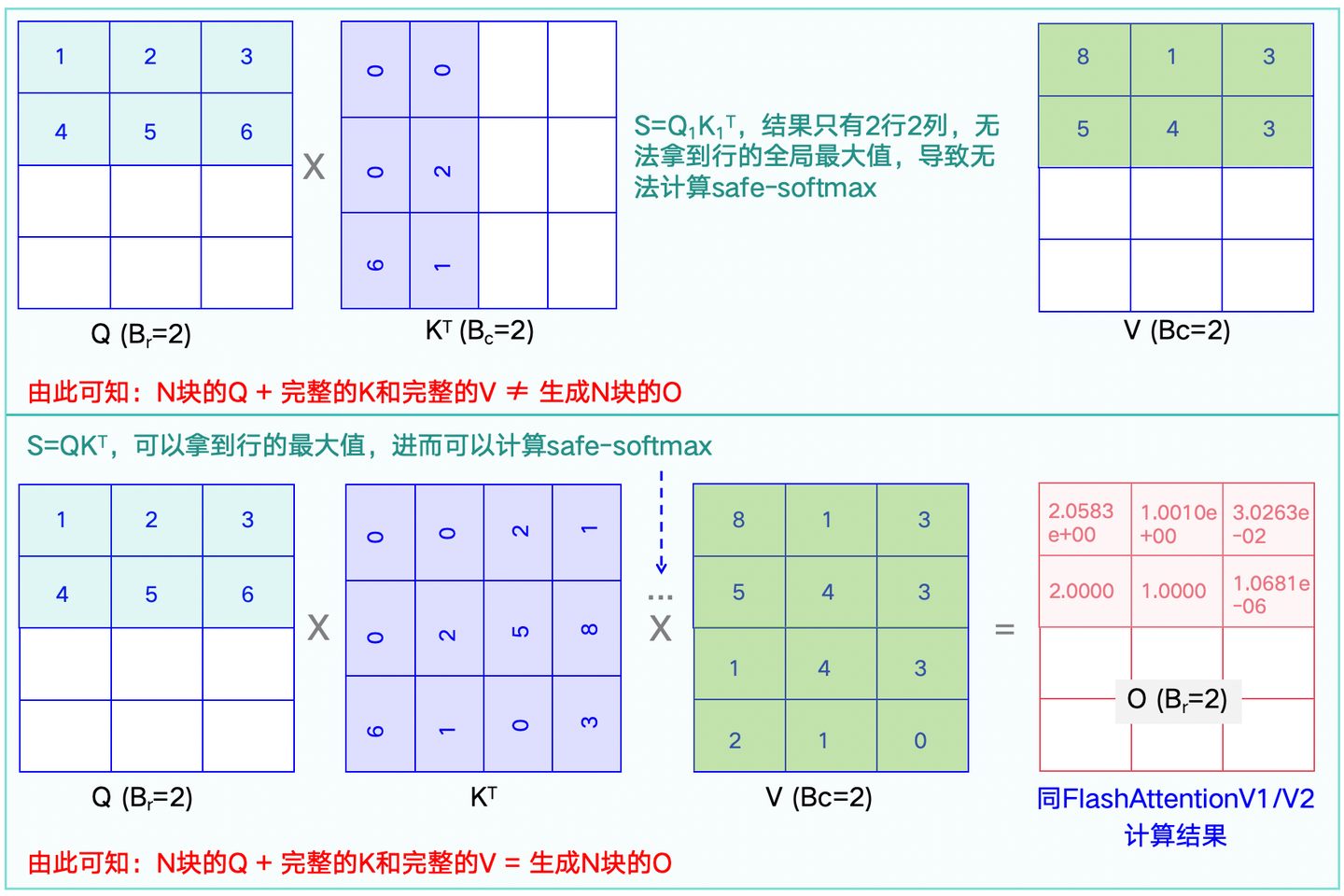

作者:假如给我一只AI https://zhuanlan.zhihu.com/p/1890132185966682238 前言:最近在学习LLM的分布式训练,看到Attention计算相关加速方法是其中重要的一环,虽然之前也碎片化学习过,但已然模糊了,本次系统总结下。本文第一章节讲解FlashAtt

作者:gurubar 原文:https://zhuanlan.zhihu.com/p/1974055240048345546 为什么World Model 在Robotics领域中非常重要? 从理论与认知科学角度,Schmidhuber 等人长期主张“智能 = 学会一个可压缩、可预测的世界”;Ha

作者:Chengru's Blog https://hypercool.cn/ai/ai_algorithms/vision/2025/08/19/dpo-rl.html 前言 过去的一个月在比较高强度做RL,最近终于有了一些阶段性成果,整理了一下整体的迭代思路和最近踩过的坑,分享出来,与各位共勉。

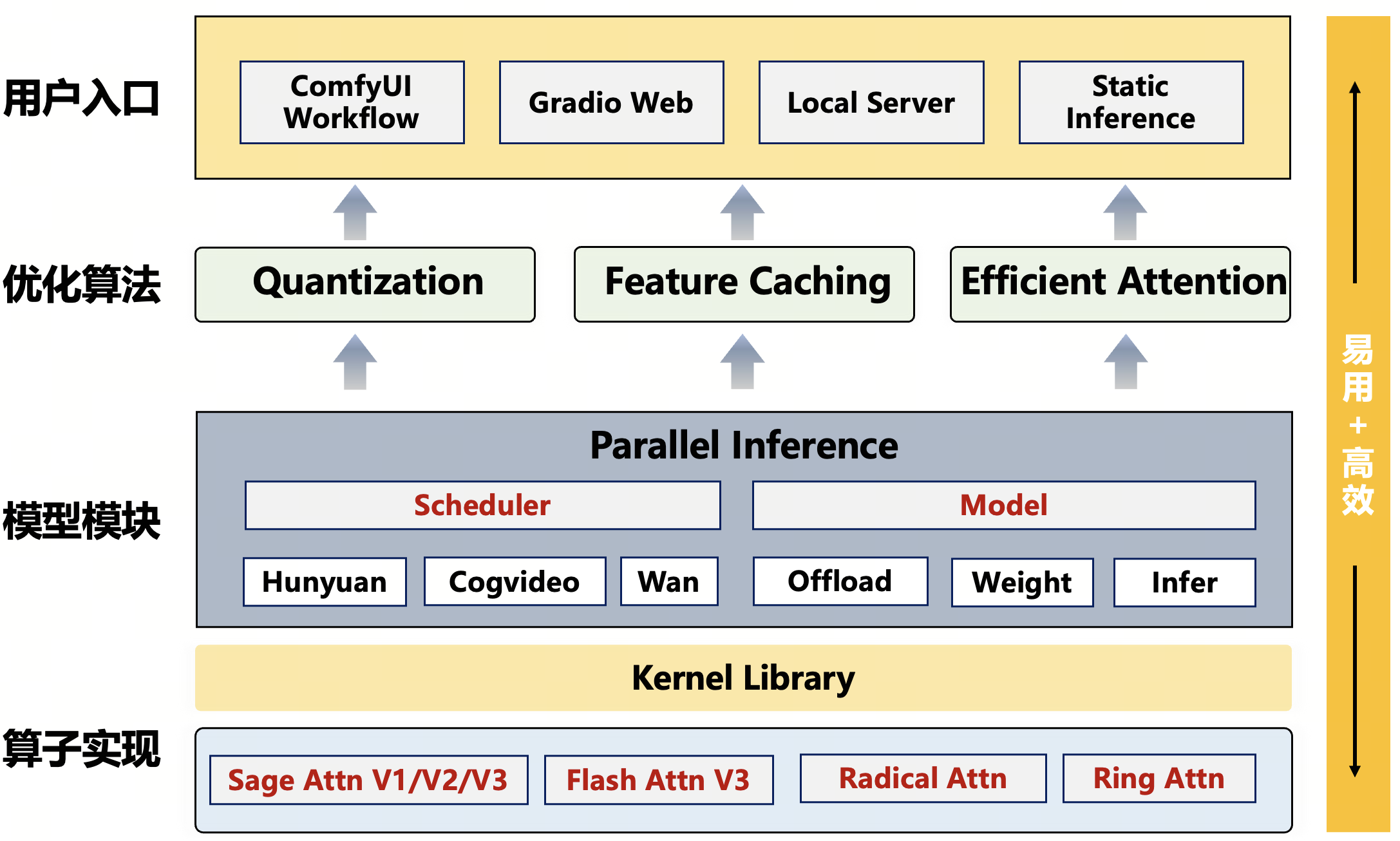

LightX2V:AI视频创作迈入实时生成时代 就在刚刚,HunyuanVideo 1.5模型正式开源,其官方页面展示了LightX2V视频生成推理框架作为首发支持方案,助力该模型在消费级显卡上实现秒级视频生成。 LightX2V源自ModelTC Github社区,其LightLLM、LightC

作者:RuYy https://zhuanlan.zhihu.com/p/1966633724058793147 最近一年都关注着Diffusion领域,与大红大紫的DiT-based视觉生成模型的不同,扩散语言模型(Diffusion Language Models,DLMs)颇有隐而不发之意,虽

作者:dung defender https://zhuanlan.zhihu.com/p/1974143141406864151 论文:Retaining by Doing: The Role of On-Policy Data in Mitigating Forgetting 链接:https:

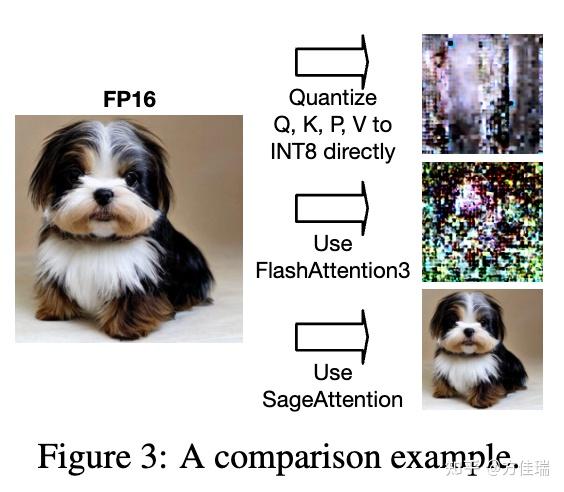

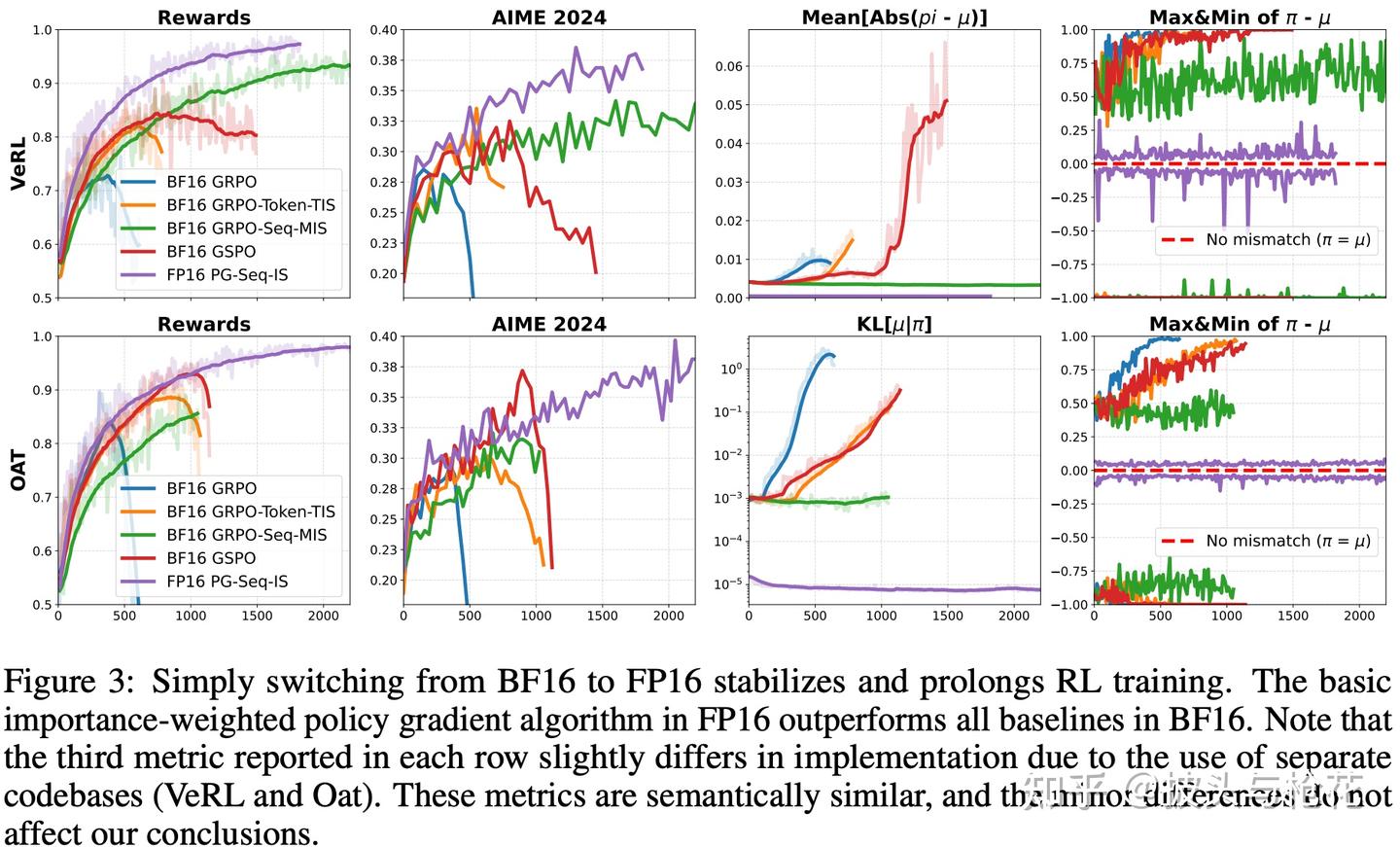

作者:披头与枪花 https://zhuanlan.zhihu.com/p/1968757538867647052 《Defeating the Training-Inference Mismatch via FP16》 https://arxiv.org/pdf/2510.26788 这篇论文直

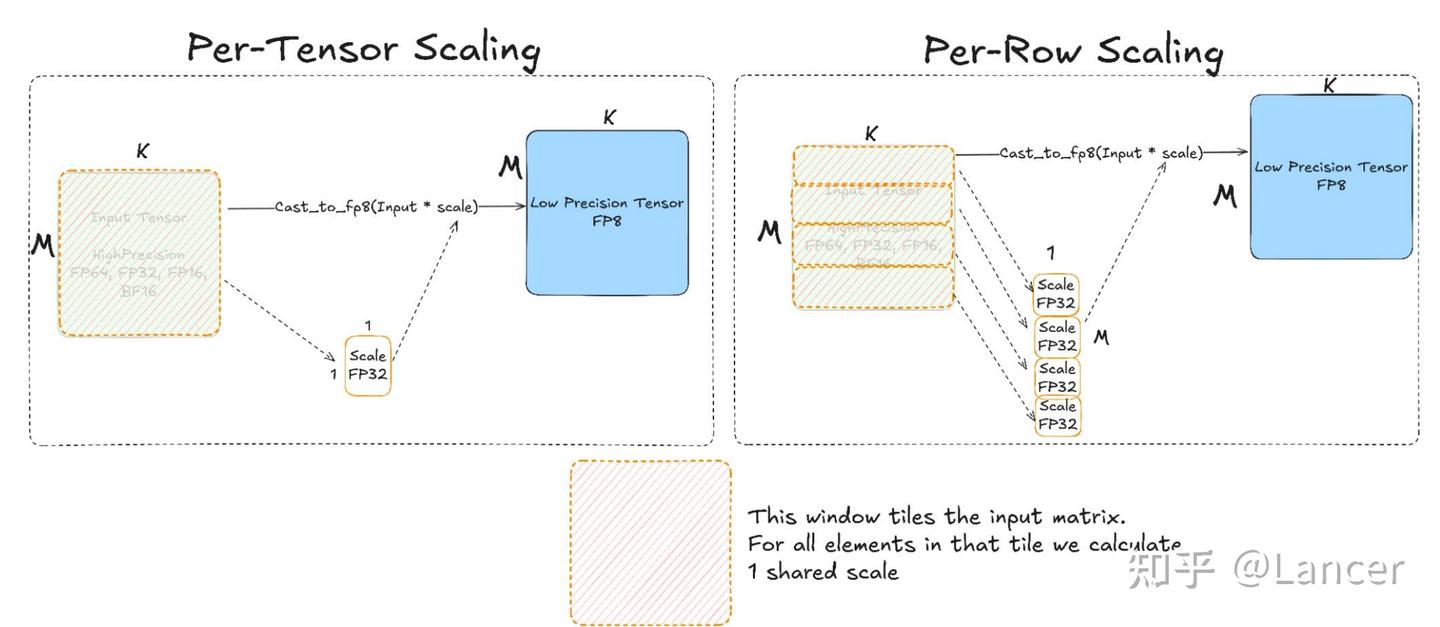

作者:Lancer https://zhuanlan.zhihu.com/p/1969465397670551963 一、 为什么需要mxfp8、mxfp4、nvfp4等低精度格式? 1.大模型规模爆炸式增长 → 计算与内存瓶颈加剧 LLM 参数量已达万亿级别,训练 FLOPs 超 10²⁵。 传统

作者:Zhennan https://zhuanlan.zhihu.com/p/78268350517 本文主要介绍 DPPO 及后续相关工作的进展,有任何补充欢迎在评论区给出,同时由于篇幅原因,本文会尽可能地写文章的 insights 以及输出我个人的观点,而不会花太多篇幅讲具体的方法论 Diff

作者:爱工作的小小酥 https://zhuanlan.zhihu.com/p/1967662447109310211 多模态大模型在提升各项能力的时候,会发现grounding能力一直处于落后的状态。很多指标都比不过专有的相关任务的模型。那么现在都有什么方法来提升大模型的这项能力呢? 今天就介绍几

作者:宇宙哇 https://zhuanlan.zhihu.com/p/1969545638023767020 《Kimi Linear: AN EXPRESSIVE, EFFICIENT ATTENTION ARCHITECTURE》,这篇论文提出了一种新的注意力架构,试图解决当前大模型在处理长文

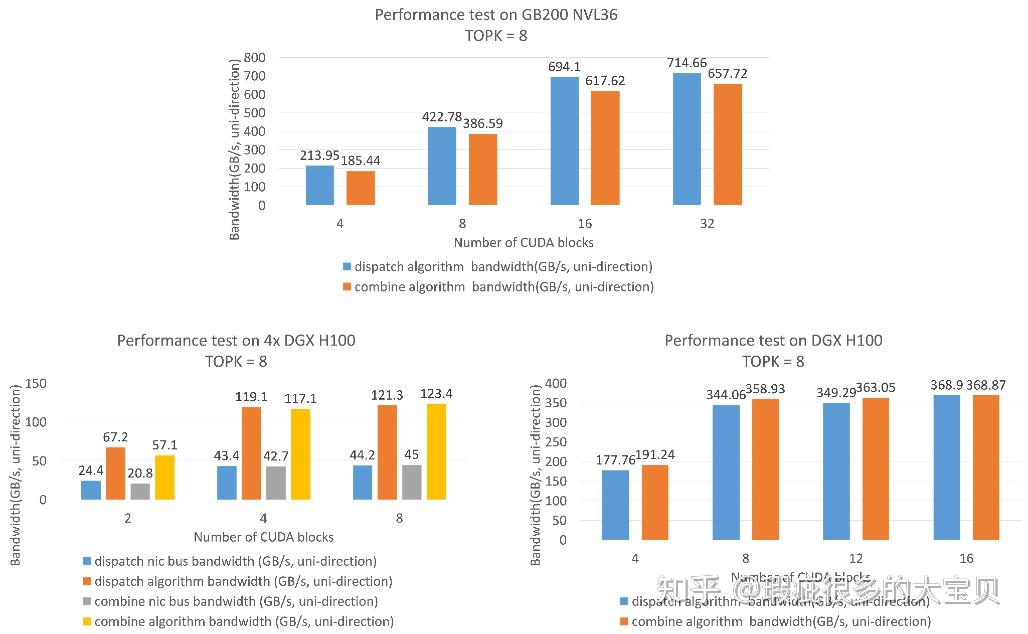

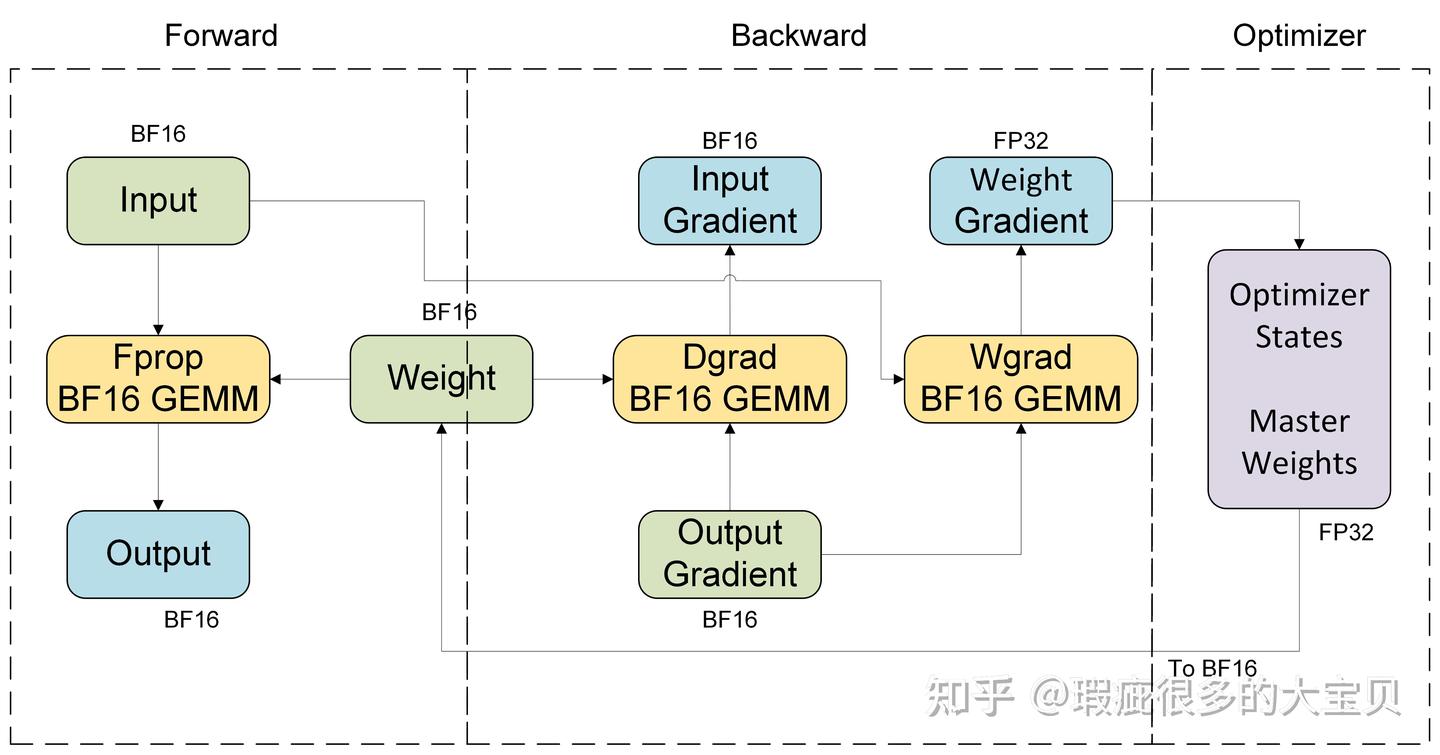

作者:瑕疵很多的大宝贝 https://zhuanlan.zhihu.com/p/1965822436948842025 声明:本文翻译自NVIDIA Megatron Core Dev Blog:Optimizing DeepSeek-V3 Training Performance on NVID

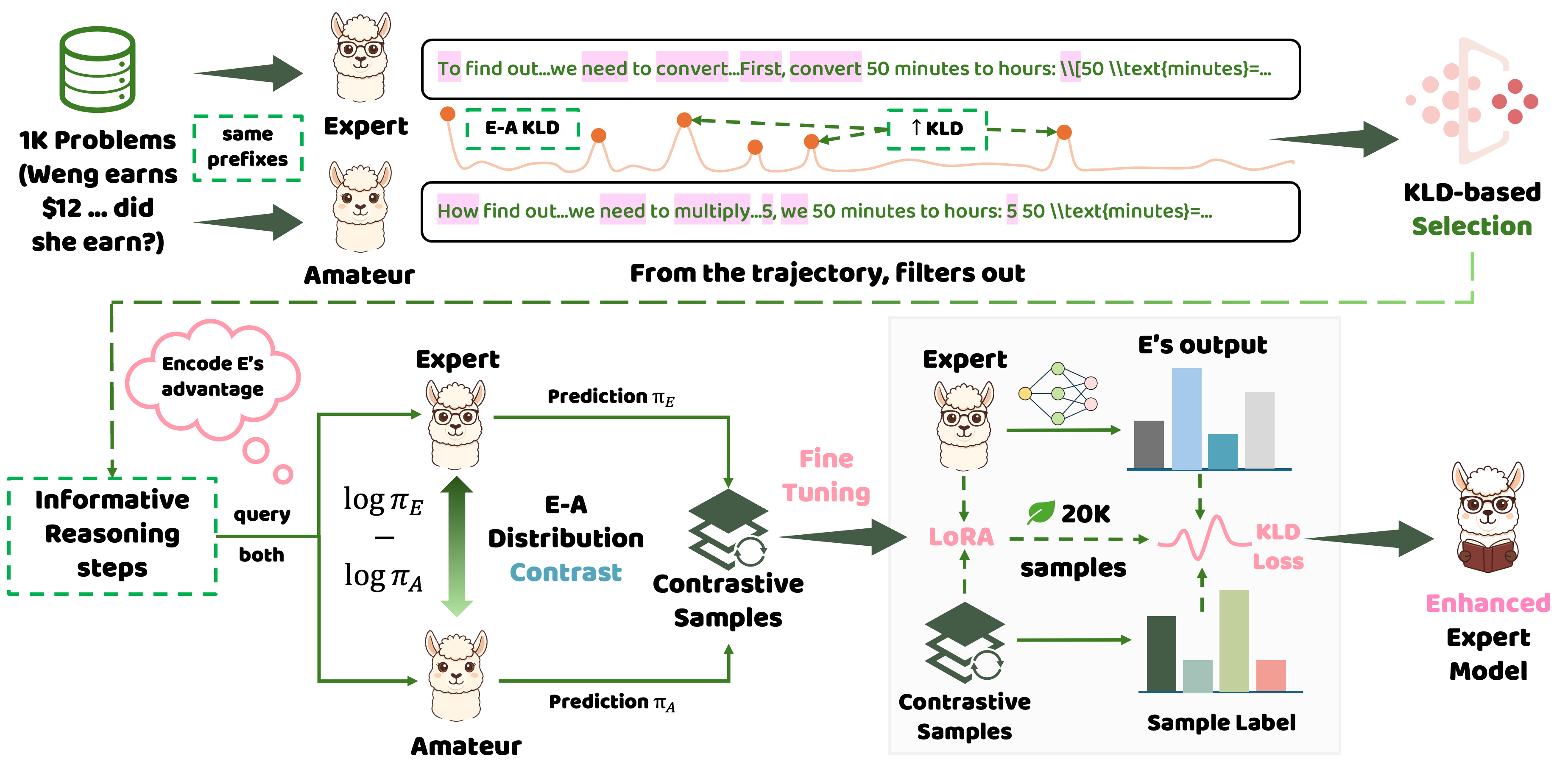

港大提出LightReasoner:让小模型教大模型“关键推理”,效率提升90%! 今天要和大家聊一篇非常有意思的工作——LightReasoner。 这篇由香港大学发表的最新论文,挑战了AI界一个习以为常的认知:“大模型一定比小模型强,小模型只能被教导,不能当老师。” 结果他们发现:小模型不仅能够

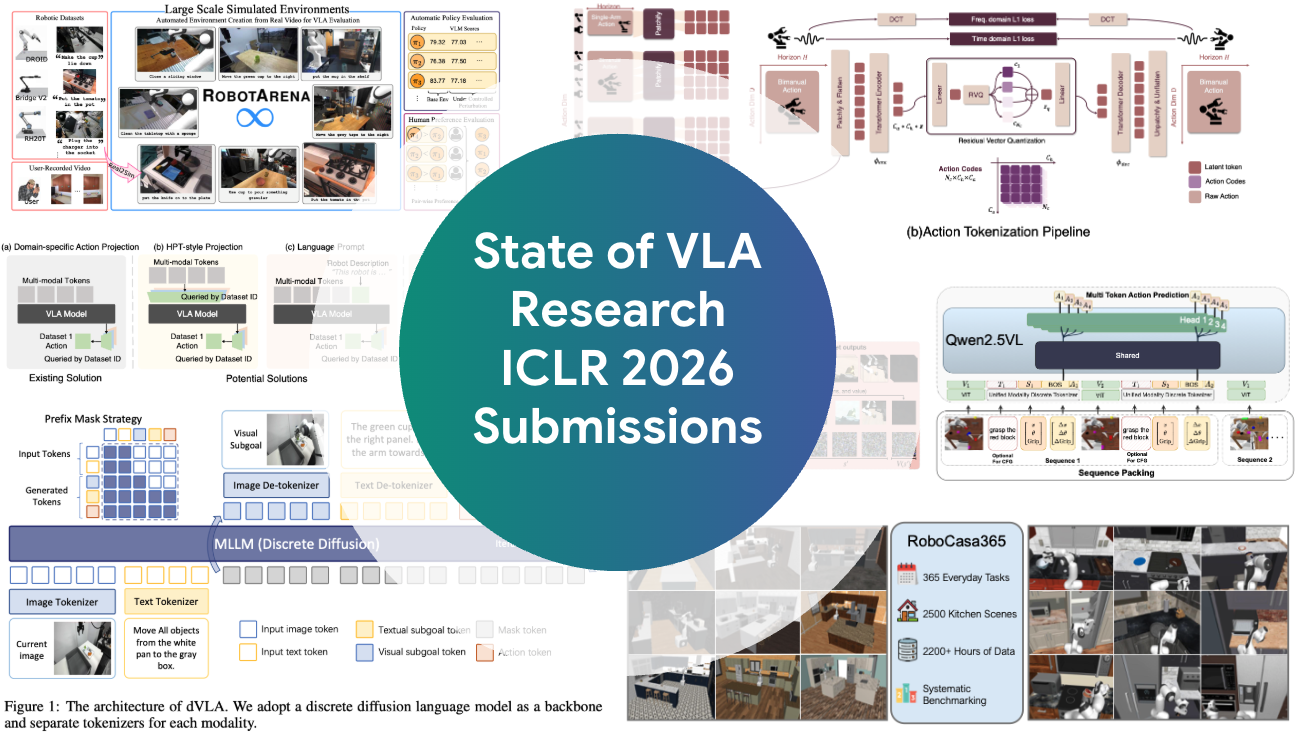

原文:https://mbreuss.github.io/blog_post_iclr_26_vla.html 本文总结了 视觉-语言-动作(VLA)模型 在 ICLR 2026 上的研究现状:什么“算作”VLA(以及为什么这个定义很重要)、当前 VLA 领域的研究热点(离散扩散、具身推理、新分词器

提到具身智能就绕不开的经典工作,自动驾驶的VLA虽然在本体确定的情况下(汽车四轮形式),也看起来只有EMMA比较合理的方案,那么来看下本体还不确定收敛的具身行业。我认为目前核心关注的应该是机械臂的操作技术突破。 (以产生和物理世界的交互,末端执行器更多使用两指夹爪、机械臂数量上的也可以任意拓展,从单

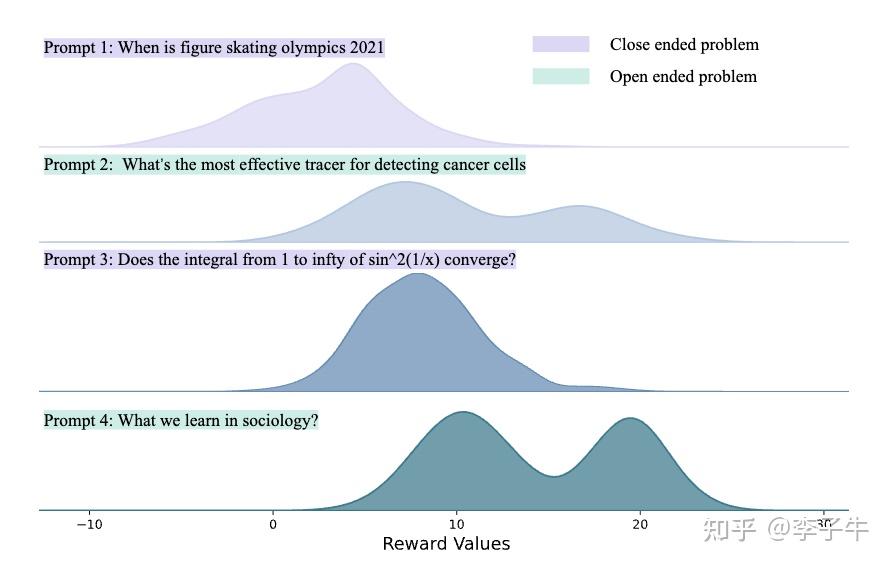

作者:李子牛 https://zhuanlan.zhihu.com/p/1963218041199387877 最近在忙毕业论文,顺便整理过去几年「大模型+强化学习」的关键进展,写了一篇综述(Review of Reinforcement Learning for Large Language Mo

作者:ybq https://zhuanlan.zhihu.com/p/1943048398333780944 这篇文章随便聊一下如今比较火的推理模型,给新入坑的同学做一些简单的科普,都是一些偏基础的知识。 推理模型的训练 推理模型的训练和普通模型的训练并无什么区别,仅仅是 sft 语料多了一些特殊

作者:ybq https://zhuanlan.zhihu.com/p/1966609550032475890 这篇文章随便聊聊 LLM RL 的一些想法。文章的灵感来自于,每次和好哥们 @真中合欢 交流 RL 训练的时候,都会被他批评一顿说不要乱加各种技巧。他成功说服了我,我也来试试看能不能说服一

作者:ning 原文:https://zhuanlan.zhihu.com/p/1967989523196667587 引言:VLA 与智能机器人的具身智能革命 Vision-Language-Action(VLA)模型是具身人工智能(Embodied AI)的核心载体,其核心价值在于打破传统机器人

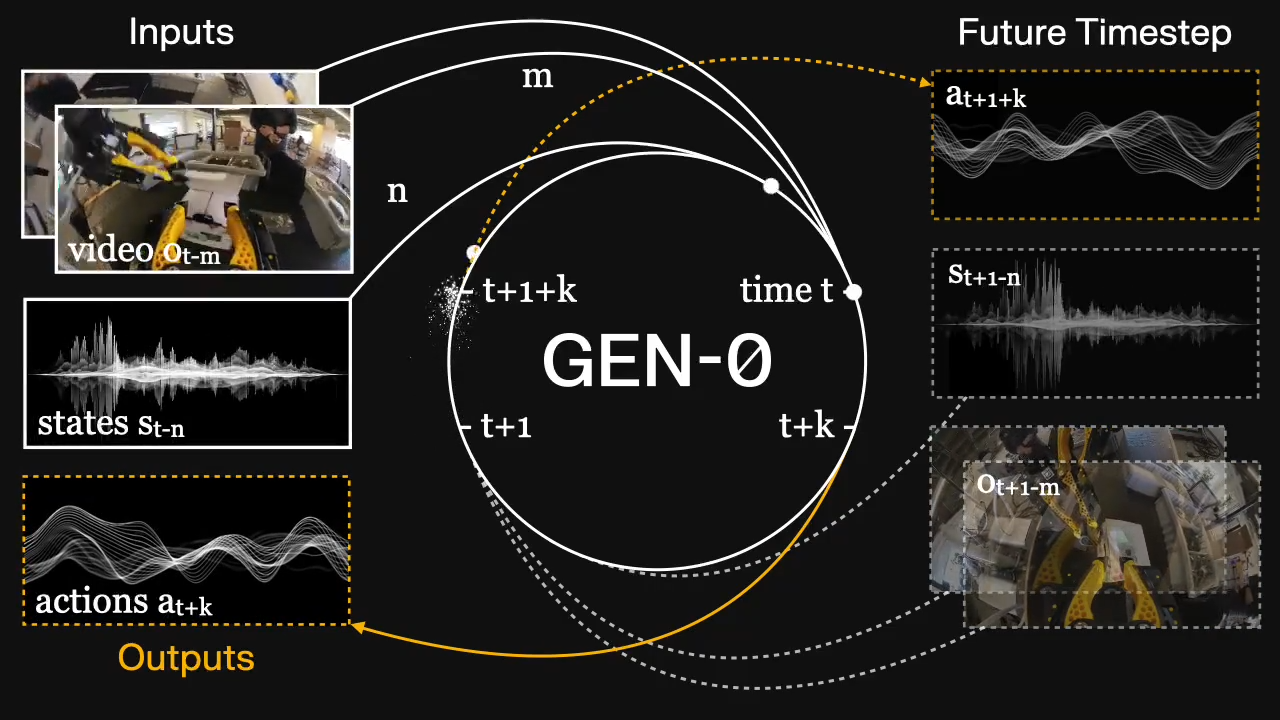

作者:阿汐 原文:https://axi404.top/blog/embodied-talk-3 GEN-0 出现的背后,我们可以从中学到什么。一些被改变,一些新的东西出现,研究还在继续。 前言 最近 GEN-0 的发布对于具身智能领域可以说是轰动性的。Manipulation 作为 Robotic

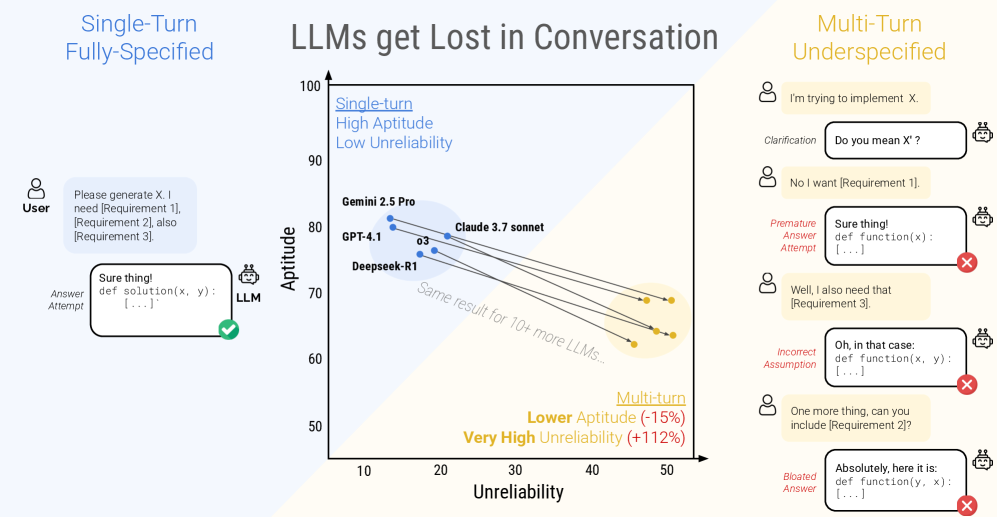

作者:木牛流码 https://zhuanlan.zhihu.com/p/1971681801295619070 引言 权威性声明:本文的核心洞见与数据,源自微软研究院(Microsoft Research)与 Salesforce 研究院(Salesforce Research)联合发表的论文《L

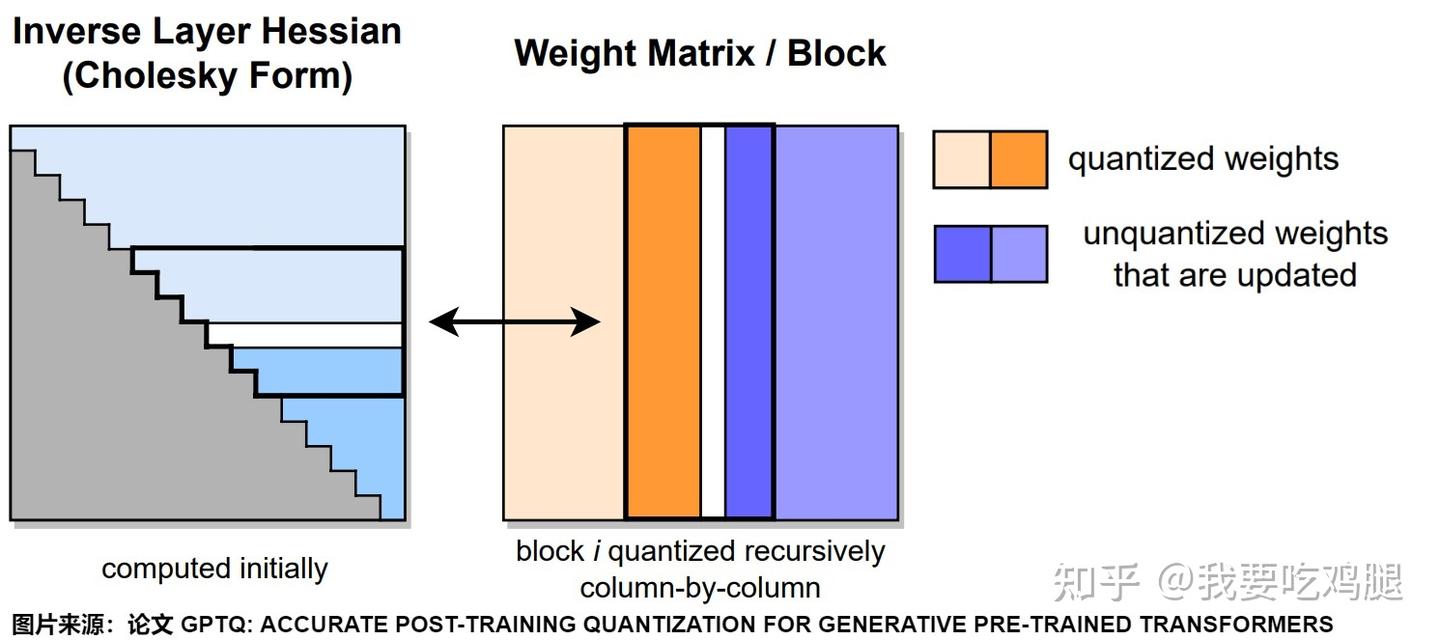

作者:我要吃鸡腿 https://zhuanlan.zhihu.com/p/1955340620299244112 4-bit量化前沿 —— 兼顾压缩与精度的黄金时代 在上一篇文章中,我们见证了8-bit量化领域三位“奠基者”的精彩博弈。它们用各自的智慧,成功地在W8A8这条路上实现了精度与效率的平

作者:张海抱 原文:https://zhuanlan.zhihu.com/p/1940702256241575450 写在前面 VLA 时代的强化学习和 Atari 时代的强化学习有什么区别?个人认为有一好两坏两个方面。 好的方面是我们现在有一个非常有用的资源 —— 预训练的大模型,它可以对我们的探

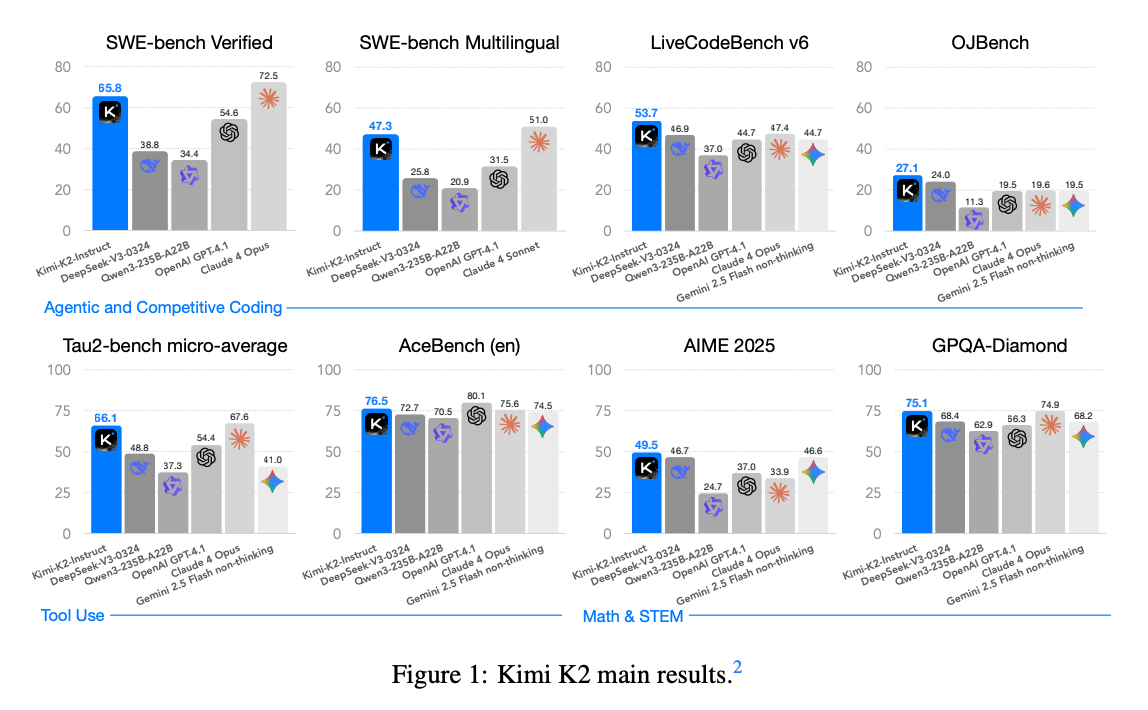

论文地址:https://arxiv.org/abs/2507.20534 Kimi k2 做了哪些优化? Kimi K2 不是传统的 “单一大模型”,而是一种叫 “混合专家(MoE)” 的架构 —— 可以理解成 “一群专家分工干活”: 总参数有 1 万亿,但每次实际工作时,只激活 320 亿参数(

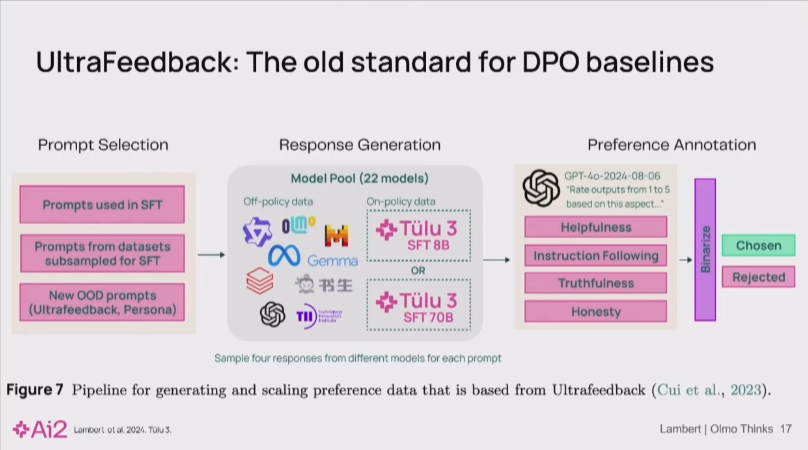

作者:JayNing https://zhuanlan.zhihu.com/p/196909645458175683 本文是Nathan Lambert在PyTorchCon 2025分享训练开源的Olmo-Thinking模型的文字笔记, 内部加入了笔者的一些批注和思考 Nathan Lamber

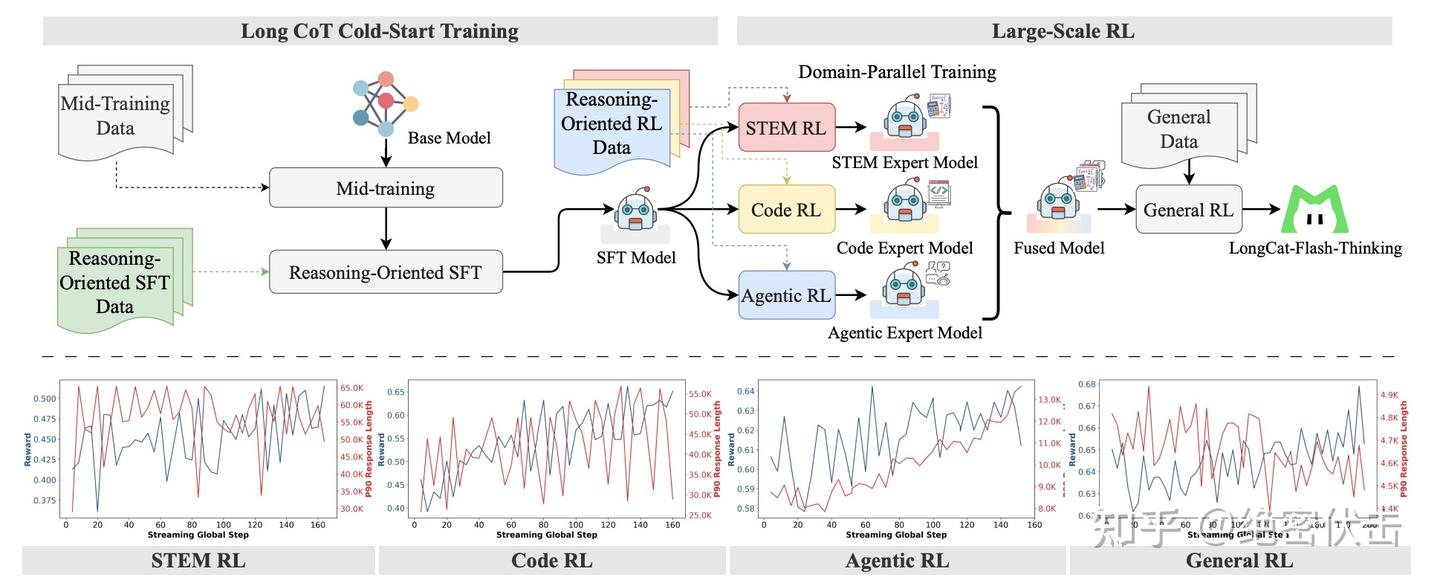

作者:刘少伟 链接:https://www.zhihu.com/question/1969558404759544488/answer/1970539327902679960 Kimi K2 Thinking 是基于**「模型即 Agent」理念训练的新一代 Thinking Agent,它原生掌握

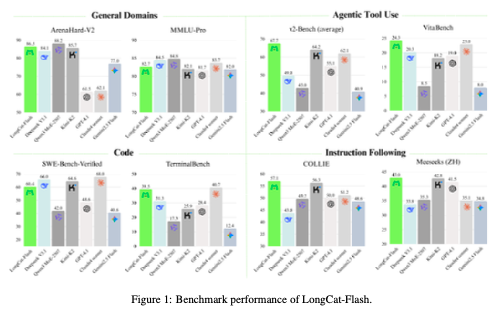

摘要 我们推出了 LongCat-Flash,一个拥有 5600 亿参数的专家混合 (Mixture-of-Experts, MoE) 语言模型,旨在兼顾计算效率与先进的智能体 (Agentic) 能力。为满足可扩展效率的需求,LongCat-Flash 采用了两项新颖设计: a) 零计算专家 (Z

作者:绝密伏击 https://zhuanlan.zhihu.com/p/1954613742634504507 技术报告:LongCat-Flash-Thinking Technical Report 链接:https://github.com/meituan-longcat/LongCat-Fl

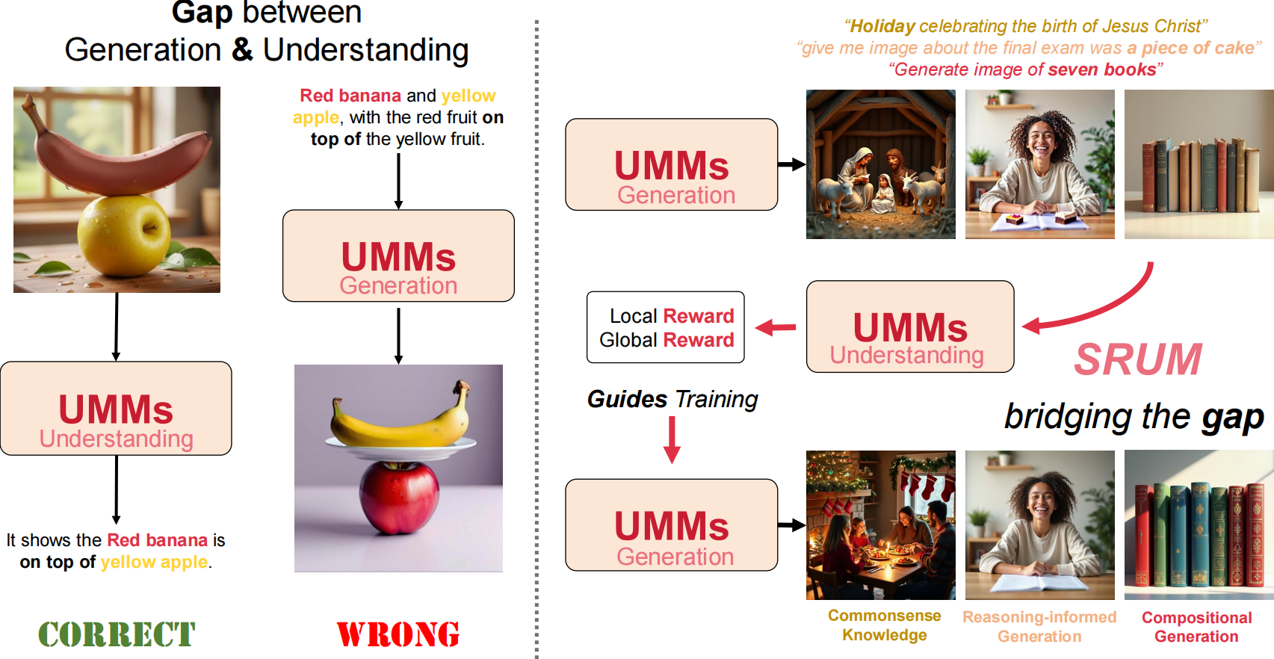

作者:金伟阳,HKU博士生 TLDR SRUM是一个非常直接的后训练方法,其动机在于:当前生成理解统一模型(UMMs)的理解端性能优于生成端,在对偶问题中生成做不好的事情理解端可以轻松解决。 由此,SRUM通过一些指令设计,能让理解端能够直接为生成端提供密集的奖励信号。实验上,仅使用约6k条提示和极

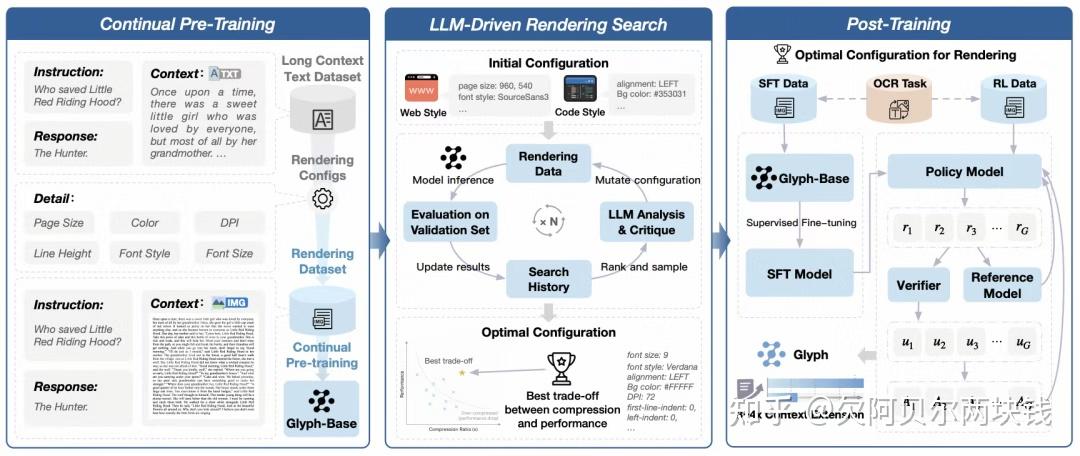

作者:欠阿贝尔两块钱 https://zhuanlan.zhihu.com/p/81560973762 DeepSeek-OCR 和 Glyph 两个模型,均以“视觉压缩”为核心思路解决大语言模型(LLM)处理长文本的痛点,谈一谈两者的区别和核心差异: 一、DeepSeek-OCR:以视觉压缩革新O

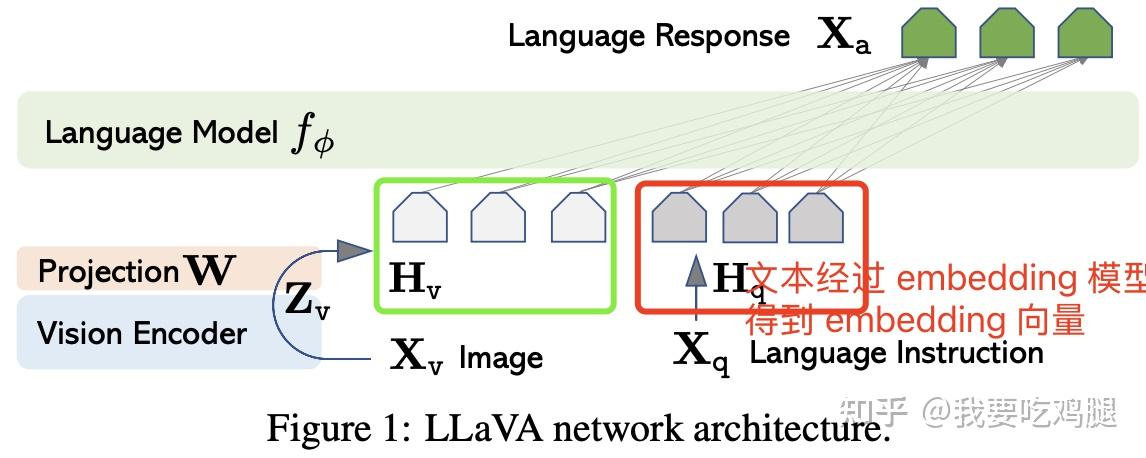

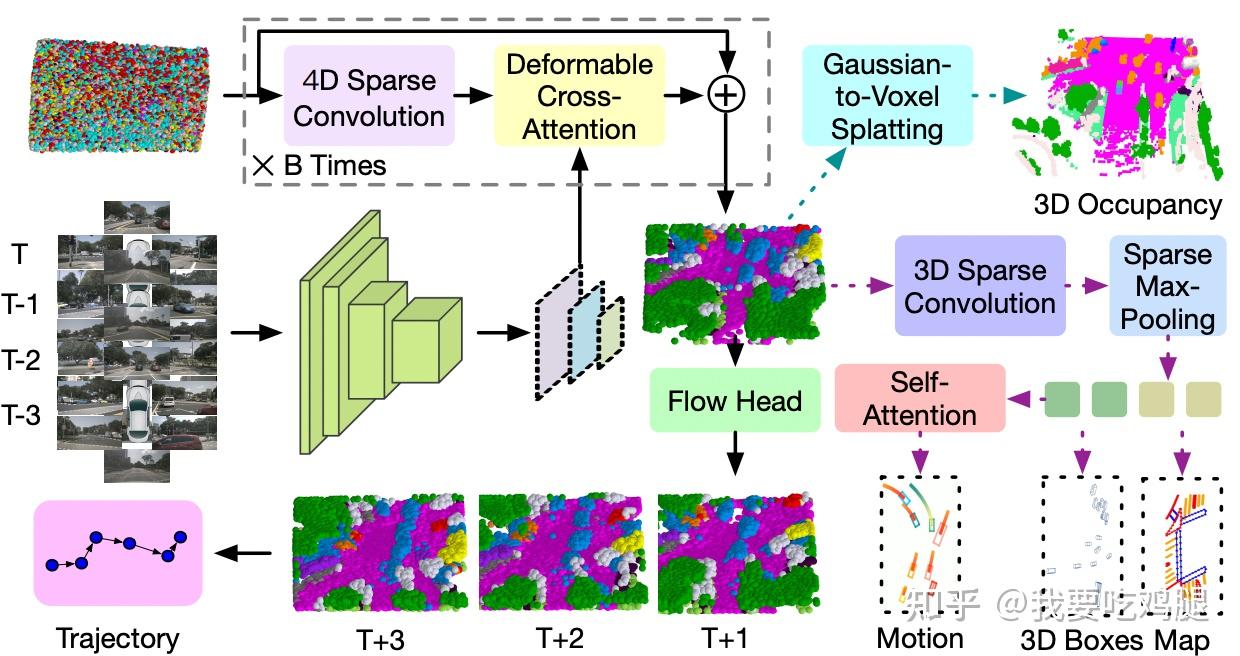

作者:我要吃鸡腿 https://zhuanlan.zhihu.com/p/1965839552158623077 在 VLA 架构解析:告别“黑箱”与“空谈”,探寻自动驾驶的“大脑”进化史——以理想汽车为例 中,我们已经清晰地辨析了“真假”VLA的区别,并按时间顺序梳理了VLA从被动的“解释器”

作者:瑕疵很多的大宝贝 https://zhuanlan.zhihu.com/p/1969540014166761755 随着 DeepSeek-V3、Ling 2.0、Minimax-M2 等顶级开源大模型纷纷使用 FP8 精度进行预训练,FP8 训练也算经受住了考验,得到了顶尖实验室的认可。本文

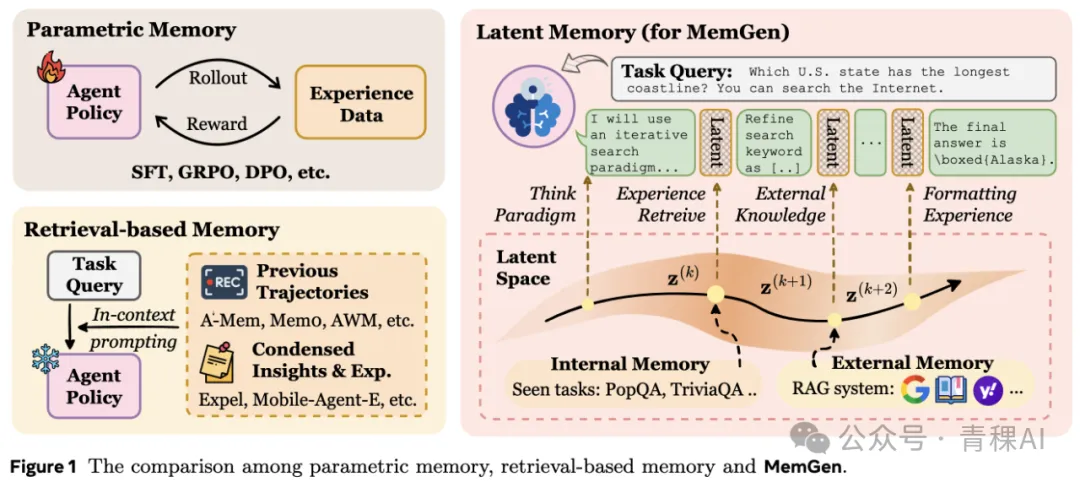

作者:Guibin Zhang # 导语 由大型语言模型(LLM)驱动的智能体(Agent)的进化路径,其核心在于记忆机制的构建。现有范式主要分为两类:其一为参数化记忆(Parametric Memory),它通过修改模型权重来内化经验,但面临灾难性遗忘的风险;其二为基于检索的记忆(Retrieva