深度对话!2025 “青稞” AI 嘉年华,与 20+ 位青年科学家一起探讨AI 技术瞬间

本次活动专为青年科学家打造,旨在搭建一场 AI 技术的深度对话,来自学术和工业界的 20+ 青年科学家,将与大家一起回顾 2025,展望 2026!

本次活动专为青年科学家打造,旨在搭建一场 AI 技术的深度对话,来自学术和工业界的 20+ 青年科学家,将与大家一起回顾 2025,展望 2026!

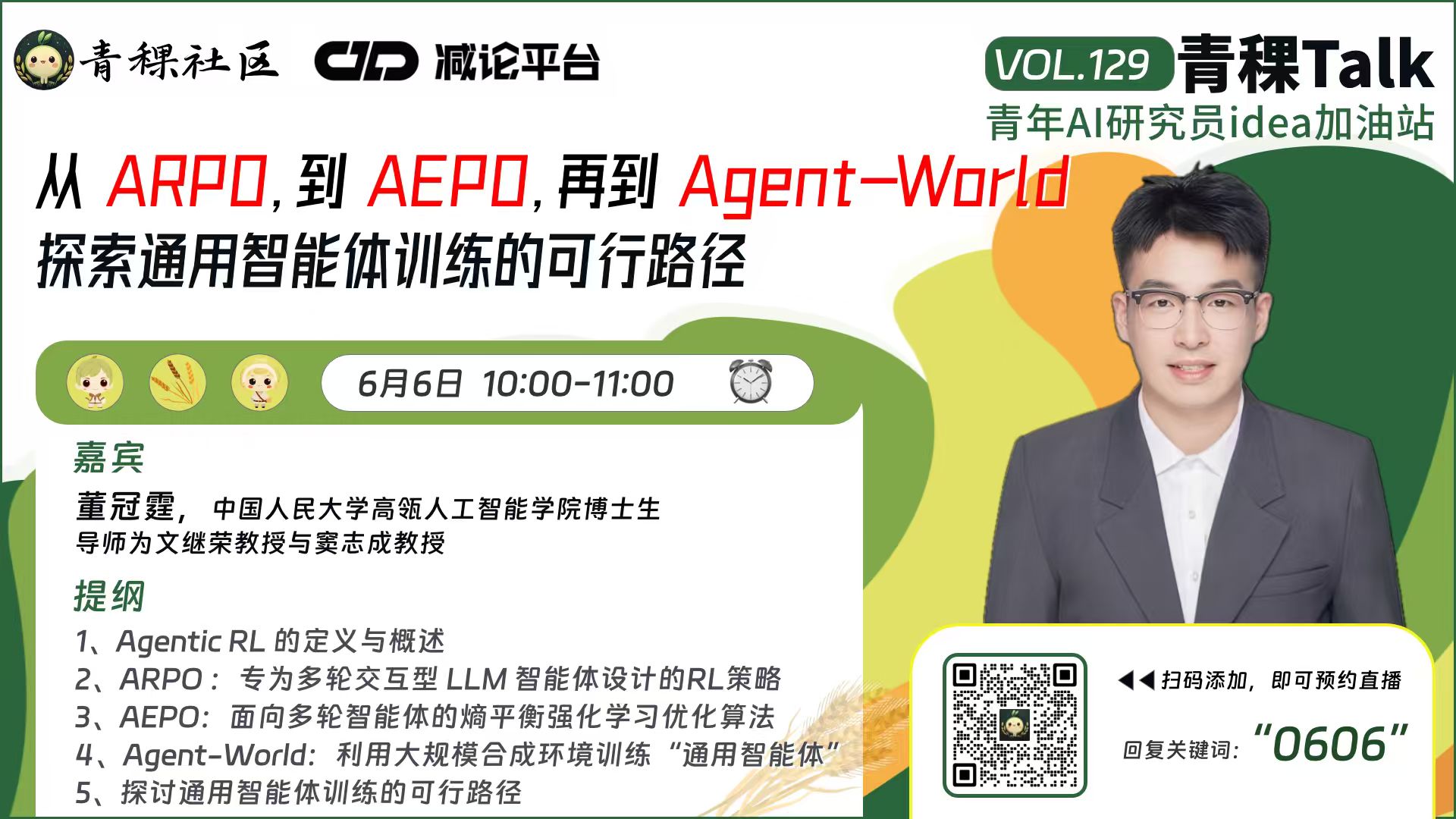

6月6日上午10点,青稞Talk 129 期,青稞社区邀请到中国人民大学高瓴人工智能学院博士生董冠霆,来直播分享《从 ARPO,到 AEPO,再到 Agent-World:探索通用智能体训练的可行路径》。 本次分享将主要围绕三篇通用智能体强化学习论文展开,沿着"智能体强化学习 → 多环境强化学习"的

大模型后训练会带来一个很现实的系统问题:模型会不断产生新版本。一次强化学习实验、一个产品功能、一个客户、一组评测结果,都可能对应一种新的模型行为。基础模型本身又非常大,动辄万亿参数规模。系统如果把每种行为都保存成一份完整模型,再分别加载和部署,成本会很快失控。 MinT 是一套面向这个问题的大模型后

δ-mem是一种面向大语言模型的轻量级在线记忆机制。不同于把历史全部塞进长上下文,δ-mem 将过去信息压缩进一个极小的在线关联记忆状态,并在生成时通过低秩 correction 直接调制 frozen Transformer 的 attention computation。 主实验中,仅使用 8

三维/四维重建技术正经历一场范式革命:从高昂的全局优化向高效的前馈式(Feed-forward)架构全面转型。 如何在长序列处理中实现极致的内存效率? 如何在统一框架下同时实现几何与运动的高精度建模? 5月19日晚8点,青稞Talk 126期,南洋理工大学(NTU)MMLab 博士生罗奕航,将直播分

在最近的大模型后训练中,On-Policy Distillation已经成为默认选项之一。 但研究者们在分析训练日志、实验曲线和对比不同 OPD 方法实现时,反复碰到同一个问题:理论上很自然的 sampled-token OPD,实际运行起来并不稳定,甚至会把模型往一些局部上“看起来合理”、整体上却

随着 OpenAI o1 和 DeepSeek-R1 的惊艳亮相,强化学习(RL)后训练(Post-training) 已成为大模型通往高阶推理能力的必经之路。 但在这一新兴领域,开发者们正面临着缺乏系统的理论指引的困境。不同于预训练阶段成熟的 Scaling Law,RL 后训练阶段的许多关键工程

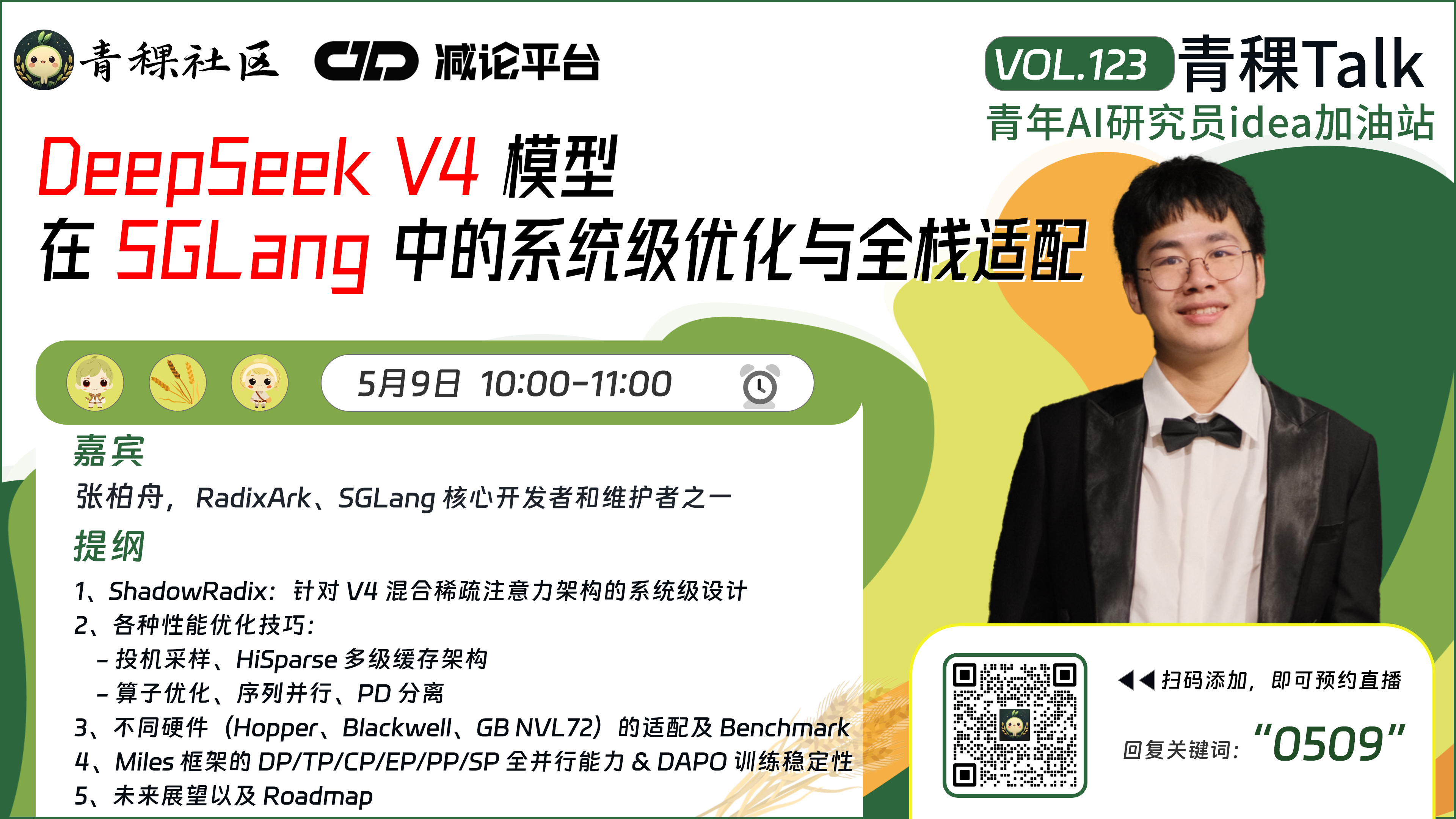

4月25日,当 DeepSeek-V4 带着 1.6 万亿参数(Pro版)和百万级上下文窗口的震撼配置横空出世时,整个大模型圈的目光都聚焦在了它极具野心的架构革新上:混合稀疏注意力(CSA+HCA)、流形约束超连接(mHC)以及 FP4 专家权重。 然而,对于广大开发者和企业用户而言,面对如此庞大且

ICLR 2026 | 大模型的无监督强化学习能走多远? 强化学习正在重塑大模型能力边界。OpenAI o3、DeepSeek-R1、Gemini 3 等顶尖模型都在用大规模 RLVR(可验证奖励强化学习)刷新推理任务的天花板。 但所有人都知道,纯监督式训练不可持续。人工标注成本指数级增长,在专业领

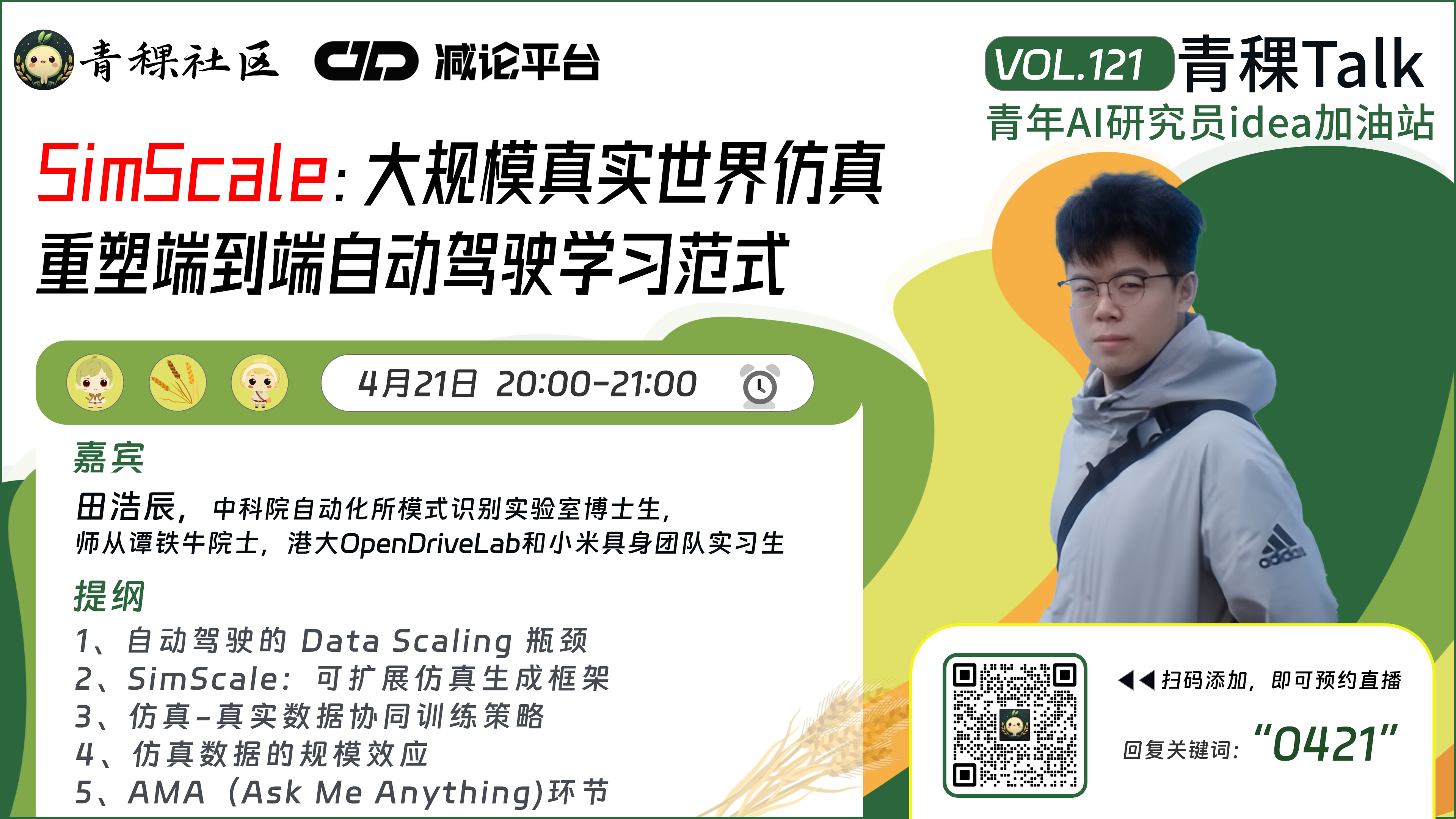

大模型因 Data Scaling 屡创新高,但在自动驾驶却失灵了——现实世界难以提供足够的关键与长尾场景,采集到的大多是价值有限的常态片段,导致数据越多、提升越难。 因此,自动驾驶的瓶颈不在规模,而在缺乏能系统生成关键场景并支撑大规模训练的新路径。 为此,来自香港大学OpenDriveLab、中科

随着大基础模型的崛起,视觉-语言-动作模型 (VLA) 展现出了极大的潜力,通过继承丰富的视觉理解和语言基础,为通用机器人策略学习提供了可扩展的途径。 然而,目前的VLA研究领域依然处于一种“原始汤 (primordial soup)”阶段——充满了各种天马行空的探索和设计,但缺乏清晰的架构。 A组

多模态空间智能不仅要求机器理解任意相机视角下的现实世界,更要求其具备从任意相机方位创造世界的能力。然而,当前的视觉与生成模型大多仅隐式地感知相机几何,或将理解与生成任务割裂开来。 新加坡南洋理工大学、商汤科技、密西根大学和马普所的研究者们联手提出了一种全新的范式——将“相机几何”破译为一种“语言”,

在人工智能的发展进程中,我们正见证从纯粹的聊天机器人向能够执行实际任务的计算机使用智能体(Computer-Use Agents) 的范式转移。 OpenClaw-RL 是第一个通过对话自动训练工业级 Agent 的强化学习(RL)库,旨在让模型在真实的交互中实现自我进化。 一、 核心理念:随处部署

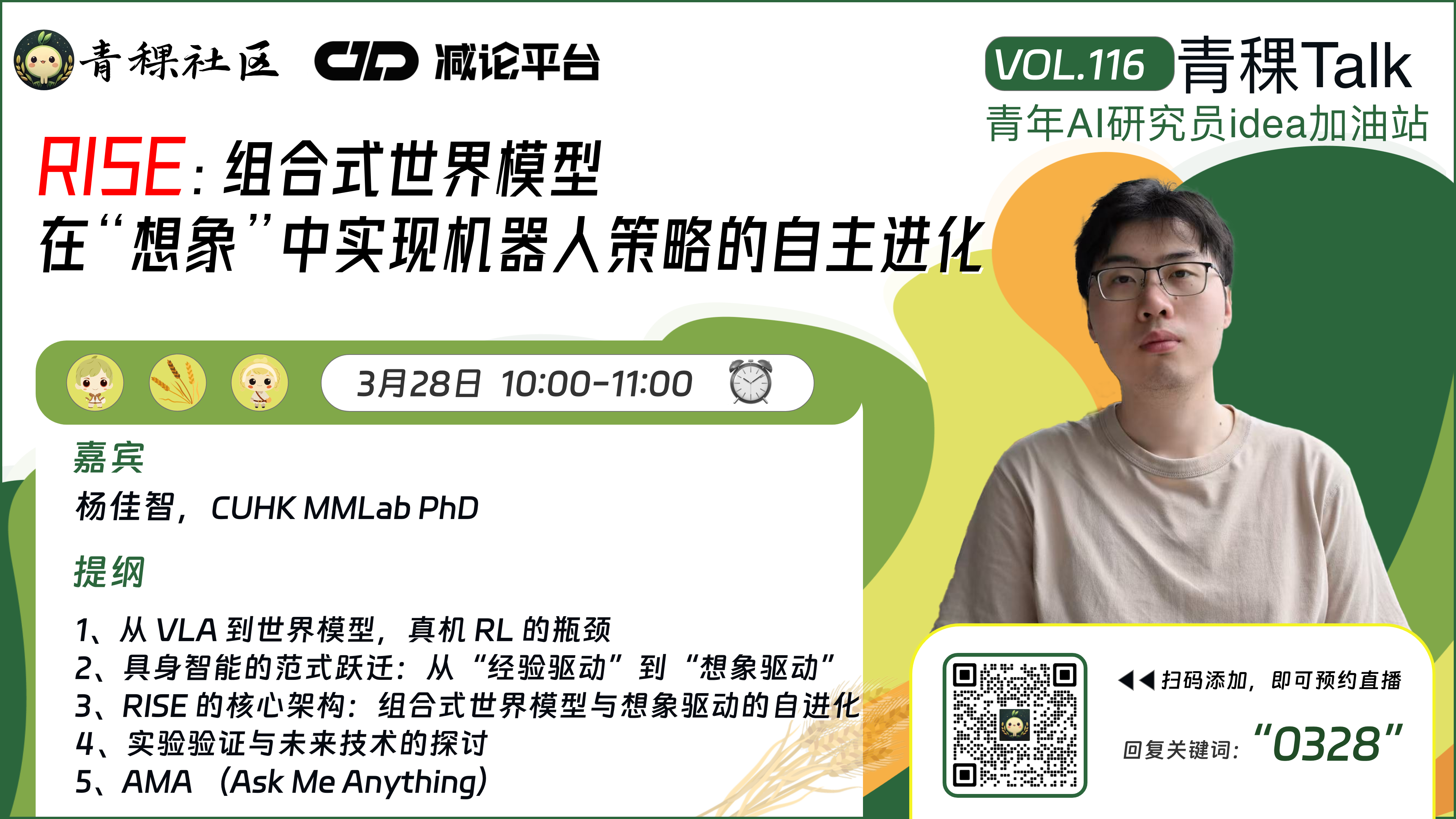

在具身智能领域,物理世界中的强化学习(RL)长期受限于高昂的硬件成本、繁琐的环境重置需求以及试错过程带来的安全风险 。 为此,OpenDriveLab提出了RISE,一种通过“想象”来实现机器人策略自主进化的可扩展强化学习框架 。 论文:RISE: Self-Improving Robot Poli

DeepSeek-R1 的成功证明,深度扩展(Depth Scaling)在复杂逻辑推理中具有巨大潜力。但当任务从“深推理”转向“广信息”——如汇总全球头部科技公司多维财务数据——单一大模型往往受限于多轮检索带来的上下文干扰与串行效率瓶颈。 为此,我们提出“广度扩展”(Width Scaling)这

动态三维建模的统一框架旨在在时间维度上同时建模场景的几何结构与运动变化,实现对动态世界的完整理解与重建。 整体框架通常包括两个核心模块: 首先是感知与表示模块,从多视角图像或视频中提取空间与时间特征,并构建统一的动态场景表示,如隐式场、3D Gaussian 或体渲染表示; 其次是几何与运动建模模块

当前主流的 LLM Agent 框架普遍采用 Text-in-Text-out 的交互范式——无论输入还是输出,所有数据都必须经过文本序列化。 这使得 Agent 难以直接操作复杂的外部对象(如 DataFrame、数据库连接、训练好的模型),其产出也无法被下游系统(数据可视化、Agentic UI

为什么开源图像编辑模型总感觉不如 GPT-4o 或 Nano-Banana 那么“听话”?核心痛点在于缺乏一个真正理解人类审美的 AI “裁判”。 3月14日(周六)上午10点,青稞 Talk 第112期,清华大学在读博士生吴科明,将直播分享《EditReward :当 AI 学会“审美”,可控多模

USER 是在 RLinf 上搭建的一套面向现实世界在线策略学习的统一且可扩展的系统。 在系统上,它建立了统一的硬件抽象层、自适应通信平面以解决硬件管理和通信问题。 算法侧,它搭建了全异步学习框架,设计了持久化、缓存感知的缓冲区,并提供了奖励函数、算法与策略的可扩展接口。

比肩 GPT-5 的 Kernel Coding 模型!Dr. Kernel 用多轮 RL 训练大模型 GPU Kernel 生成 让大模型通过强化学习(RL)生成 GPU Kernel 是业界共同的期望。但由于极易受“钻漏洞(reward hacking)”和“惰性优化(lazy optimiza

LLM RL 训练轨迹竟然是线性的?Miaow Lab 最新工作:无需继续训练,直接“预测”未来模型! 研究发现,在RLVR训练过程中,LLM的权重和输出概率演化呈现出显著的线性特征,理论分析发现,这源于低学习率、大Batch Size及Adam优化器的特性。说明昂贵的RLVR存在大量冗余计算。 基

大型语言模型(LLM)展现出强大的推理与编程能力,但在真实世界的软件工程(SWE)任务上仍难以泛化。这类问题往往涉及长时序决策,并且具有明显的 Out of Distribution问题。 现有系统通常依赖单一智能体处理 SWE 任务。它需要在一条推理链中同时进行需求理解、浏览大型代码库以及实现修复

如果有人说:不用分阶段训练、不搞课程学习、不动态调参,只用最基础的 RL 配方也能达到不错的性能,会是怎样的结果? 我们团队用两个 1.5B 模型做了这个尝试。结果在 9 个数学推理基准上达到了 54.87% 和64.32% 的新基线,算力只用了一半,训练过程也很平稳,4000步没遇到什么大问题。 更有趣的是,当我们试着加入一些"应该有用"的优化时,性能反而下降了。也许在某些情况下,简单的方法充分训练后,效果可能比我们预期的要好。这个工作最大的 novelty,也许就在于没有 novelty。

随着大模型能力的不断提升,越来越多的研究开始在RL(强化学习)训练中同时优化多种偏好(如正确性、格式、长度、bug ratio等)。 我们发现多奖励强化学习(multi-reward RL)中经常会遇到训练不稳定的问题,并非主要源于奖励设计或权重冲突,而是优势信号在归一化过程中被“压扁”,导致分辨率下降,提出“advantage collapse”这一关键问题。 传统 GRPO 在多奖励场景下的 group-wise normalization 会使不同奖励组合的样本难以区分,削弱学习方向。 为此,研究提出 GDPO,通过逐奖励解耦归一化保留细粒度优势差异,并在聚合后进行 batch 归一化以稳定尺度。实验表明,GDPO 在工具调用、数学推理和代码推理任务中显著提升了训练稳定性与最终性能。 该工作指出,多目标 RL 的核心在于保持训练信号清晰度,为推理模型与智能体训练提供了更可诊断、可复用的方法论。

为应对具身智能领域数据采集成本高且效率低、模型泛化不足以及训练范式难以规模化的瓶颈,上海人工智能实验室具身智能中心提出了“高质量合成数据驱动+统一学习框架”的数据-模型协同方案。 论文:InternVLA-A1: Unifying Understanding, Generation, and Act

视觉模型长期面临语义抽象与像素细节难以统一建模的问题,现有要么擅长理解,要么擅长生成,却难以兼得。 像 ViT、ResNet 这样的语义模型,能精准识别图像中的物体类别,却无法重建出一张清晰的图片; 而像 MAE、GAN 或扩散模型这样的生成系统,虽能合成逼真的像素细节,却常常“看不懂”自己画的是什

扩散模型(Diffusion Models)在视觉生成领域取得了举世瞩目的成就,但其昂贵的迭代采样过程——通常需要几十甚至上百步推理——极大限制了实时应用部署。 近期,关于扩散模型蒸馏(DMD) 的两篇重量级论文引发了学术界与工业界的广泛关注。它们不仅刷新了 4 步成像的质量极限,更从根本上重新定义

引言 在大模型后训练阶段,强化学习(Reinforcement Learning, RL)已成为提升模型性能的关键技术。从早期的PPO到最新的SAPO,算法演进始终围绕训练稳定性、样本效率和计算开销三大核心挑战展开。 1 理论基石:TRPO与策略优化基础 1.1 TRPO的核心思想 信任域策略优化(

在大型语言模型(LLM)的强化学习(RL)阶段,特别是人类反馈强化学习(RLHF)中,我们追求策略 \pi_\theta 的持续优化。 然而,LLM 的复杂性和分布式训练特性,带来了一系列独特挑战,这些挑战在数学上可以统一归结为一个核心问题:策略部署(rollout)与策略更新(\pi_\theta

随着 GenAI 视觉模型(如 Sora 2、Google Nano Banana)的爆炸式发展,其惊人的效果背后是庞大的计算资源消耗。图像和视频模型的推理 FLOPs 甚至远超 LLM,导致部署成本高昂,难以普及。 SANA系列模型作为高效生成式基础模型的前沿探索,通过引入线性注意力(Linear

大语言模型(LLM)的强化学习(RL)微调常因训练与推理策略间的数值不匹配而面临训练不稳定的问题。相比在算法上引入重要性采样来打补丁,我们发现直接从根源上提高浮点数的精度更加有效。 论文:Defeating the Training-Inference Mismatch via FP16 链接:ht

11月18日(周二)晚8点,青稞Talk 第90期,同济大学博士生刘洪博,将直播分享《ShotBench: 面向增强MLLM摄影语言理解能力的训练与评估体系》。 论文:ShotBench: Expert-Level Cinematic Understanding in Vision-Language

训练与人类意图对齐的多模态大模型是一个长期挑战。传统的基于分数的奖励模型在强化学习(RLHF)中存在准确性低、泛化性弱和可解释性差等问题。 11月15日(周六)上午10点,青稞社区和减论平台将联合组织青稞Talk 第89期,并邀请到北京大学博士生周嘉懿,直播分享《Generative RLHF-V:

高保真三维资产生成在多个行业中至关重要。尽管近期的三维预训练模型在生成逼真内容方面表现出强大能力,但大多数模型基于diffusionmodels,并采用“两阶段”流程:先生成几何结构,再合成外观。这种解耦式设计常导致几何与纹理的不对齐,以及较高的计算成本。 论文:UniLat3D:Geometry-

11月8日(周六)上午10点,青稞Talk 第87期,香港大学直博生黄炜,将直播分享《RL 训练框架:QeRL,量化技术增强强化学习 Reasoning 探索》。 分享嘉宾 黄炜,香港大学三年级直博生,师从齐晓娟教授。英伟达研究院Efficient AI & Learning and Percept

长文本建模在智能体、文档问答等任务中具有重要意义,但传统方法在扩展上下文窗口时往往面临计算与内存开销巨大的挑战。 近期,视觉文本压缩(光学文本压缩)的概念因 DeepSeek-OCR 的提出而备受关注,其证明了文本信息可通过图像形式实现近乎无损的压缩与恢复。 在这一背景下,我们的同期工作 Glyph

11月4日(周二)晚8点,青稞Talk 第85期,NUS AI Researcher倪瑾杰,将直播分享《OpenMoE 2: Sparse Diffusion Language Models》,聊一聊为什么 Diffusion MoE 可能是下一代大模型架构方向。 分享嘉宾 倪瑾杰,NUS AI R

VLA模型已成为使机器人在真实环境中解决各类复杂操作任务极具前景的新范式,其发展仍受限于数据稀缺与泛化能力不足等问题,而强化学习能缓解数据依赖并显著提升模型性能与泛化性,正受到广泛关注。 本次报告将解读所提出的专为VLA模型设计的高效强化学习框架SimpleVLA-RL,内容主要分为三部分: • 首

10月28日(周二)晚8点,青稞Talk 第83期,清华大学博士生吕兴泰,将直播分享《统一 SFT & RL:迈向大型语言模型后训练的统一视角》。 分享嘉宾 吕兴泰,清华大学二年级博士生,导师为周伯文教授。研究方向为大语言模型架构优化、强化学习和高效训练技术。在ACL,EMNLP,NeurIPS,I

来帮社区的同学“还愿”了!!! OpenCUA 是港大联合月之暗面提出的一个全面的开源框架,旨在扩展CUA的数据和基础模型,使用户可以高效、低门槛开发自主操作电脑的Agent。 论文:OpenCUA: Open Foundations for Computer-Use Agents 链接:https

更多解读请阅读:最新成果!Agent记忆的第三种可能:生成式隐式记忆 10月16日(周四)晚8点,青稞Talk 第81期,新加坡国立大学博士生张桂彬,将直播分享最新成果《MemGen:生成式隐式记忆,Agent Memory 的第三种可能》。 分享嘉宾 张桂彬是新加坡国立大学计算学院博士研究生,导师

10月21日(周二)晚8点,青稞Talk 第80期,清华大学博士生张开颜,将直播分享《RL for LRMs:探讨面向推理模型的 RL 最新研究》。 分享嘉宾 张开颜,清华大学三年级博士生,导师为周伯文教授。研究方向为大语言模型测试时扩展(Test-time Scaling)、强化学习和多智能体协同

10月18日(周六)上午10点,青稞Talk 第79期,伊利诺伊大学香槟分校 (UIUC) 博士生钱成,将直播分享《“知人者智”:以用户为中心的智能体交互与训练》。 分享嘉宾 钱成,伊利诺伊大学香槟分校 (UIUC) 二年级博士生,导师为季姮教授。本科就读于清华大学计算机系,导师为刘知远教授。目前工

9月18日(周四)晚8点,青稞Talk 第78期,新加坡国立大学博士生张桂彬,将直播分享《从 LLM-RL 到 Agentic RL:如何让语言模型成为自主智能体》。 分享嘉宾 张桂彬是新加坡国立大学计算学院博士研究生,导师为颜水成教授,研究方向为Multi-Agent System,Agent M

9月9日(周二)晚8点,青稞Talk 第77期,香港中文大学王鸿儒博士,将直播分享《Theory of Agent: From Definition, to Behavior and Objective》。 分享嘉宾 王鸿儒博士于香港中文大学获得博士学位,导师为黄锦辉教授(ACL Fellow),研

9月6日(周六)上午10点,青稞Talk 第76期,英伟达NeMo团队高级深度学习算法工程师李之愈,以及高级产品经理高文雯,将直播分享《NeMo RL:让大规模 MoE 模型权重 Refit 加速 10 倍》。 分享嘉宾 李之愈是英伟达NeMo团队高级深度学习算法工程师,专注于大语言模型预训练以及后

8月30日(周六)上午11点,青稞Talk 第75期,加州大学圣地亚哥分校(UCSD)博士生姚峰,将直播分享《FlashRL:探讨现代 RL 框架中推理与训练的错位问题及解决方案》。 分享嘉宾 姚峰,加州大学圣地亚哥分校(UCSD)二年级博士生,导师是商静波教授,曾在微软研究院Deep Learni

8月23日(周六)上午10点,青稞Talk 第74期,淘天集团未来生活实验室算法专家王维埙博士,爱橙科技智能引擎算法平台大模型强化学习框架工程师熊绍潘,将直播分享《ROLL:面向 Agentic 场景的生产级大规模强化学习训练框架》。 代码:https://github.com/alibaba/RO

8月19日(周二)晚8点,青稞Talk 第73期,马里兰大学博士生陈玖海,将直播分享《从BLIP3o到BLIP3o-NEXT:迈向统一生成与理解的多模态大模型》。 代码:https://github.com/JiuhaiChen/BLIP3o 主题提纲 从BLIP3o到BLIP3o-NEXT:迈向

8月16日(周六)上午10点,青稞Talk 第72期,西湖大学修宇亮实验室访问学生李博谦,将直播分享 ICCV 2025 Highlight Paper 成果《ETCH: 通过等变紧度向量将人体拟合推广到穿衣人体的方法》。 论文:ETCH: Generalizing Body Fitting to

关于RLPR的技术报告解读:RL突破通用领域推理瓶颈!清华NLP实验室提出基于参考概率奖励的强化学习RLPR 8月12日晚8点,青稞Talk 第71期,清华大学自然语言处理实验室博士生余天予,将直播分享《RLPR:基于参考概率奖励的强化学习,推广 RLVR 到通用领域推理问题》。 分享嘉宾 余天予,

8月9日(周六)上午10点,青稞Talk 第70期,南洋理工大学MMLab博士生田淑琳,将直播分享 ACL 2025 Oral 成果《Evaluation Agent:面向视觉生成模型的高效可提示的评估框架》。 论文:Evaluation Agent: Efficient and Promptabl

8月7日晚8点,青稞Talk 第68期,通义千问研究员,Qwen3、QwQ系列开源模型核心贡献者郑楚杰,将直播分享《GSPO:迈向持续拓展的语言模型强化学习》。 GSPO算法解析:DeepSeek-GRPO重要性权重设计错误?详解Qwen3新强化学习算法GSPO 论文:Group Sequence

8月2日(周六)上午10点,青稞Talk 第68期,智谱 AI RL Infra 工程师、slime 开源项目作者朱子霖,将直播分享《slime:专为 RL Scaling 设计的大规模 RL 训练框架及实践》。 https://github.com/THUDM/slime 关于slime的分析可

8月5日晚8点,青稞Talk 第67期,Sea AI Lab(新加坡)算法工程师,新加坡国立大学博士生万信逸,将直播分享《大模型训练流水线并行四部曲:吞吐、内存、负载均衡与线性扩展》。 分享嘉宾 万信逸,Sea AI Lab(新加坡)算法工程师,新加坡国立大学博士生,专注机器学习系统领域的创新与突破

论文:Automatic Expert Discovery in LLM Upcycling via Sparse Interpolated Mixture-of-Experts 链接:https://arxiv.org/abs/2506.12597 7月26日上午11点,青稞Talk 第66期,香

7月22日晚8点,青稞Talk 第65期,香港中文大学(深圳)GAP实验室博士生叶崇杰,将直播分享《Hi3DGen:法线为桥,为高清三维几何生成另辟蹊径》。 分享嘉宾 叶崇杰, 香港中文大学(深圳)GAP实验室在读博士, 师从韩晓光教授。 主题提纲 Hi3DGen:法线为桥,为高清三维几何生成另辟蹊

李飞飞&谢赛宁空间智能新作!“认知地图+语言推理+RL优化”是逼近人类空间认知能力的有效路径 7月19日上午10点,青稞Talk 第64期,纽约大学访问学生尹柏乔和西北大学博士生王启能,将直播分享他们与李飞飞&谢赛宁等人合作的,在空间智能领域上的最新成果:MindCube,探讨空间智能可能的新路径。

7月15日晚8点,青稞Talk 第63期,华南理工大学与IDEA 联合培养博士蒋擎,将直播分享《ChatRex & RexSeek & RexThinker: 结合多模态大语言模型的目标检测模型构建》。 分享嘉宾 蒋擎,华南理工大学博士生,IDEA-CVR 实习生。其主要研究方向为开集目标检测,多模

7月12日上午10点,青稞Talk 第62期,英伟达公司研究员刁诗哲,将直播分享《ProRL: 延长强化学习训练框架,拓展大语言模型的推理边界》。 分享嘉宾 刁诗哲,英伟达公司研究员,曾以访问学者身份在伊利诺伊大学厄巴纳-香槟分校从事研究,并在字节跳动人工智能实验室与创新工场人工智能研究院实习。研究

GUI-Reflection,是一个开源的,让端到端多模态GUI模型学会自我反思和纠错的自动化框架。GUI-Reflection在智能体的各个训练阶段引入 “反思与纠错”机制,这一机制贯穿预训练、监督微调和在线训练全过程,模拟了人类“犯错→反思→重试”的认知过程,使模型在面对真实环境中的不确定性时,

7月5日(周六)上午10:00,青稞Talk 第60期,新加坡科技设计大学博士生曾广韬,将直播分享《Satori-SWE:用 Evolutionary Test-Time Scaling 让小语言模型解决复杂软件工程》。 分享嘉宾 曾广韬,新加坡科技设计大学的四年级博士生,研究方向为 Large L

往期解读:聊聊在大模型推理强化学习中熵机制上的探索 强化学习已经成为大模型智能跃升的下一个增长点,在这个背景下,本文旨在解决将强化学习用于大语言模型推理时面临的一个主要障碍——策略熵塌缩问题。 这种现象在大量未引入熵干预的强化学习训练中普遍出现,表现为策略熵在训练初期急剧下降,探索能力随之减弱,并始

人工智能与机器人技术的飞速发展,正在引领人类社会迈向一个人与机器人共处的新阶段,这将带来深刻的社会变革与挑战。 为探索这一未来,来自马萨诸塞大学阿默斯特分校、约翰霍普金斯大学和卡内基梅隆大学的研究者构建了“虚拟社区”平台——一个基于真实地理场景和通用物理引擎的开放世界模拟环境。 在这一平台中,研究者

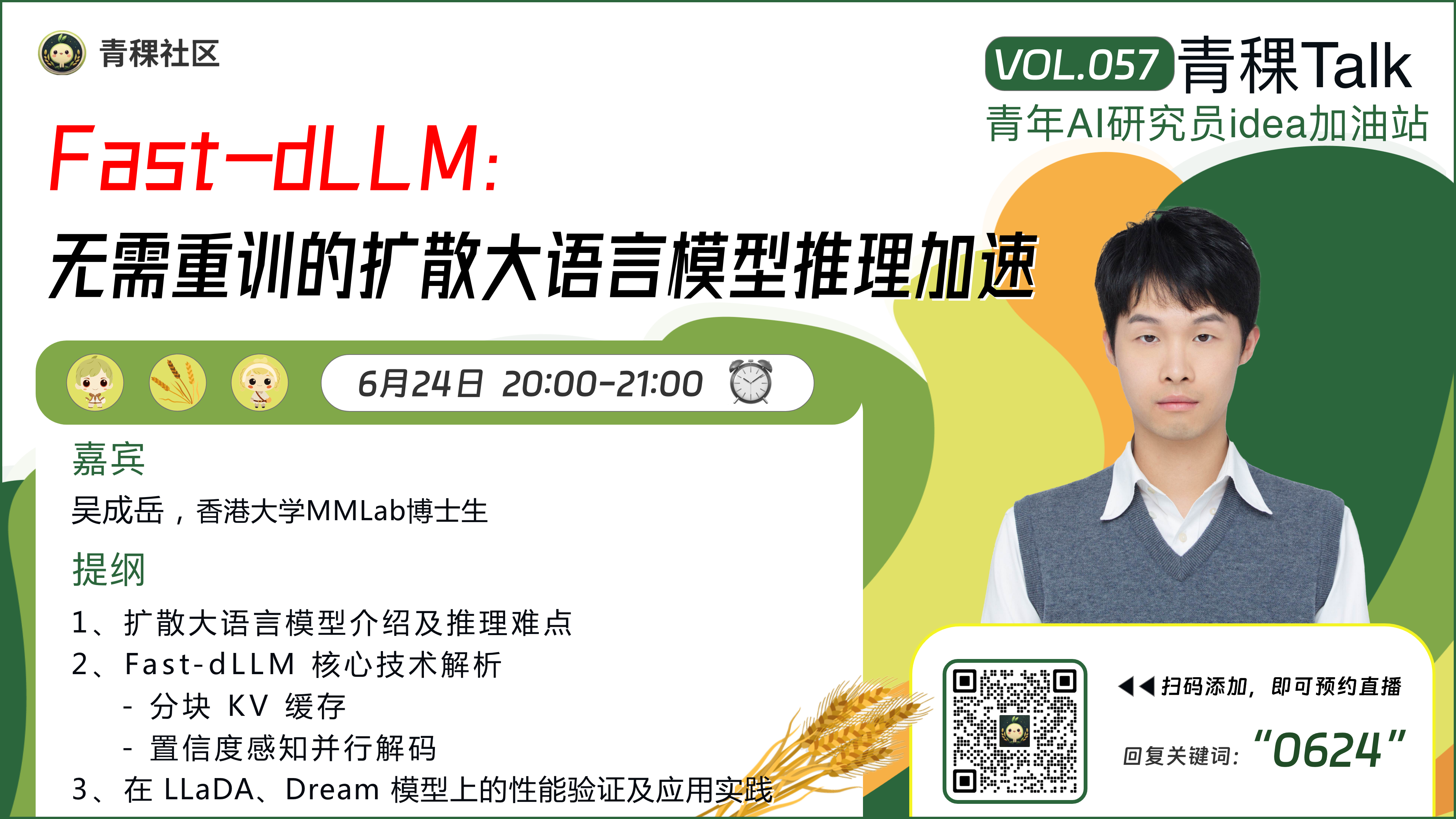

Fast-dLLM 是NVIDIA联合香港大学、MIT等机构推出的扩散大语言模型推理加速方案。 其通过分块KV缓存与置信度感知并行解码技术,在无需重新训练模型的前提下,实现了推理速度的突破性提升——在LLaDA模型1024 token长文本生成任务中,端到端推理速度狂飙27.6倍,整体耗时从266秒

发展更为通用的智能技术是下一代人工智能的重要突破口,学习一个可以广泛应用于各种模态和各种任务的通用感知模型是发展更为通用的智能技术的重要步骤。 6月21日10:00点,青稞Talk第56期,复旦大学博士生王玮赟,将直播分享《InternVL3,GPT-4o开源平替:多模态通用感知大模型的技术演进与应

6月16日20:00,青稞Talk 第55期,新加坡国立大学博士生张扬,将直播分享《生成模型中的极简概念擦除》。 分享嘉宾 张扬,慕尼黑工业大学计算机专业硕士,新加坡国立大学人工智能专业博士。曾于牛津大学进行学术访问,并在微软亚洲研究院及美国运通新加坡数据中心实习。研究成果发表在ICML、NeurI

6月12日20:00,青稞Talk 第54期,BAGEL 一作、中国科学院博士生黎昆昌,将直播分享《BAGEL:统一生成理解的多模态基础模型》。 关于 BAGEL 的更多细节请参考:字节Seed开源BAGEL: 更聪明的统一生成理解模型 分享嘉宾 黎昆昌,中国科学院博士五年级,导师是乔宇、王亚立,研

6月9日20:00,青稞Talk 第53期,论文成果一作、微软亚洲研究院高级研究员宋恺涛,将直播分享《Chain-of-Model (模型链):引入因果建模,全新的大模型 Scaling 结构》。 分享嘉宾 宋恺涛,微软亚洲研究院高级研究员,博士毕业于南京理工大学。其主要研究方向为自然语言处理,大语

5月29日上午9点,青稞Talk 第52期,加州大学伯克利分校计算机科学博士生席浩诚,将直播分享《Sparse VideoGen:无需重新训练的视频扩散 Transformer 推理加速框架》。 分享嘉宾 席浩诚,加州大学伯克利分校计算机科学博士一年级学生,师从Kurt Keutzer教授,研究方向

5月26日晚8点,青稞Talk 第51期,青稞社区联合创始人高岱恒, 将分享ICLR 2025最新成果《EraseAnything:在 Flux 等先进文生图架构的概念擦除方法》 主题提纲: EraseAnything:在 Flux 等先进文生图架构的概念擦除方法 1、什么是 AIGC 的概念擦除

LM在多个领域表现出强大能力,尽管在线服务广泛应用,但出于隐私和离线需求,个人常需要端侧部署。然而,现有的基于MoE和Transformer架构的LLM在端侧部署时面临显存容量不足的挑战。 5月22日20:00,青稞Talk 第50期,北京大学智能学院博士生、华为诺亚方舟实验室实习生节世博,将直播分

5月19晚8点,verl core contributor 童雨轩,将直播分享《verl 源码解读 与 HybridFlow 编程范式讲解》。 本次 Talk 会从entrypoint(例如 main_ppo.py)入手,按程序执行顺序讲解 verl 的主要逻辑(类似 debugger 视角,但经过

在预训练 Scaling Law之后,测试时扩展(Test-time Scaling, TTS)已成为提升大模型推理能力的关键。OpenAI o1与DeepSeek R1等模型通过强化学习(RL)进行推理的范式,充分展现了TTS的潜力。然而,推理模型的性能上限仍深受基础模型(其架构与预训练数据)的制

Free4D,是由华中科技大学、MMLab@NTU以及湾大的研究者最新提出的一种无需调整的新型框架,可用于从单个图像生成 4D 场景。 Paper:Free4D: Tuning-free 4D Scene Generation with Spatial-Temporal Consistency Ab

TinyZero由加州大学伯克利分校的研究团队开发的,也是首个DeepSeek R1-Zero的干净、简洁、易于获取的全开源复现,目前已11.6k Star。同时,它只需 30 美元就能模拟花费600万美元的DeepSeek R1-Zero 的推理。 TinyZero 以veRL为基础进行构建,采用

基于强化学习框架的自我提升正日益成为增强模型推理能力的关键后训练方法,这一方法直接促成了DeepSeek-R1的成功。 青稞Talk 第45期,香港科技大学(HKUST)计算机系博士生曾伟豪,将直播分享《B-STaR & SimpleRL-Zoo:通过强化学习自我提升推理性能和效率》。 B-STaR

主讲嘉宾 张怡颖,现任加州大学圣地亚哥分校计算机科学与工程系副教授。她的研究领域涵盖人工智能系统与数据中心云计算系统,当前主要致力于构建下一代的AI Agent系统。她曾获得OSDI最佳论文奖、SYSTOR最佳论文奖、美国国家科学基金会CAREER奖,以及来自谷歌、Meta、亚马逊、英特尔、VMwa

3月29日上午11点,青稞Talk第43期,VideoGrain第一作者、UTS ReLER lab博士生杨向鹏,将在线讲解《VideoGrain:基于扩散模型的多粒度视频编辑的探索与应用》。 主题提纲 VideoGrain:基于扩散模型的多粒度视频编辑的探索与应用 1、现有视频编辑方法概述和挑战

3月22日上午11点 ,青稞Talk 第42期,COAT 第一作者、加州大学伯克利分校计算机科学博士生席浩诚,将直播分享《COAT:显存高效的 FP8 训练,实现高效深度学习》。 分享嘉宾 席浩诚是加州大学伯克利分校计算机科学博士一年级学生,导师是Kurt Keutzer教授,研究方向为大型语言模型

3月15日上午11点,青稞Talk 第41期,阿里通义实验室高级算法工程师张熙,将直播分享《PC-Agent:面向复杂 PL 任务的多模态智能体框架》。 分享嘉宾 张熙,博士毕业于中科院自动化研究所,目前担任阿里通义实验室高级算法工程师,负责多模态智能体Mobile-Agent等工作。在国际顶级期刊

3月8日上午11点,青稞Talk 第40期,商汤科技大模型工具体系团队研究员、LightLLM 核心开发人员白世豪,将直播分享《基于 LightLLM 的 DeepSeek R1/V3 模型部署实战》。 分享嘉宾 白世豪,商汤科技大模型工具体系团队研究员,LightLLM核心开发人员,主要负责大语言

2月22日上午11点,青稞Talk 第39期,上海人工智能实验室青年科学家崔淦渠,将直播分享《PRIME: 结合隐式过程奖励的强化学习》。 主讲嘉宾 崔淦渠,上海人工智能实验室青年科学家,博士毕业于清华大学计算机系,导师为刘知远副教授。研究方向为大语言模型的对齐与强化学习技术。在ICML, Neur

2月15日上午11点,青稞Talk 第38期,Satori第一作者、MIT博士生沈茂昊,将直播分享《Satori:通过训练LLM做自回归搜索来增强推理能力》。 主讲嘉宾 沈茂昊,MIT EECS系四年级博士生,长期和MIT-IBM Watson AI lab 合作,本科毕业于UIUC ECE系。研究

.png)

1月14日19:00,青稞Talk 第37期,香港科技大学(广州)博士生许添硕,将直播分享《Motion Dreamer:面向自动驾驶与物理世界对齐的视频生成模型》。 主讲嘉宾 许添硕,香港科技大学(广州)博士生,导师为陈颖聪教授,研究兴趣是自动驾驶、视频生成。 主题提纲 Motion Dreame

主讲嘉宾 马跃,香港科技大学计算机博士生,清华大学电子信息硕士,主要研究领域是视频生成、图片生成等,曾在百度,腾讯 AI Lab,腾讯混元作为算法研究实习,在NeurIPS,Siggraph,AAAI,CVPR,TMM等发表多篇高水平文章,曾经获得北京市优秀毕业生等荣誉称号。 主题提纲 Follow

12月28日11点,青稞Talk 第35期,香港科技大学广州博士生周子凯,将直播分享《Tuning-Free Enhence:通过噪声初始化和采样轨迹优化增强预训练扩散模型》。 主讲嘉宾 周子凯,香港科技大学广州博士生。研究方向为扩散模型与模型压缩,发表IJCAI,NIPS等多篇论文。 主题提纲 T

12月24日20点,青稞Talk 第34期,中国科学院自动化研究所博士生、新加坡国立大学访问博士生李志凯,将直播分享《K-Sort Arena:视觉生成模型的高效人类偏好竞技场》。 主讲嘉宾 李志凯,中国科学院自动化研究所博士生,新加坡国立大学访问博士生。研究方向为高效深度学习和模型压缩,以第一作者

12月21日11点,青稞Talk 第33期,CMU 博士生董易昕,将直播分享《XGrammar:高效实现 LLM灵活且可移植的结构化生成》。 分享嘉宾 董易昕,卡内基梅隆大学计算机科学系的一年级博士生,导师为陈天奇教授;本科毕业于上海交通大学计算机科学专业(ACM班);研究聚焦于机器学习与系统的交叉

12月16日晚8点,青稞Talk第32期,商汤科技研究院谷石桥和雍洋两位模型压缩研究员,将对LLMC进行直播分享,主题为《LLMC:大语言模型压缩工具的开发实践》。 他们将从工具框架设计,常用算法解读和工具使用方式等角度,为大家详细讲解LLMC及实践,希望大家可以从中获益。 主讲嘉宾 谷石桥,商汤科

12月14日11点,青稞Talk 第31期,深度求索(DeepSeek)研究员、UT Austin博士刘星超,将直播分享《Rectified Flow:矫正流生成式模型的概念及应用实践》。 主讲嘉宾 刘星超,深度求索(DeepSeek)研究员,UT Austin博士,师从刘强教授。研究兴趣是生成式模

11月30日上午11点,微软研究院 AI Frontiers 实验室高级研究员鲁亚东,将直播分享《OminiParser:基于纯视觉的 GUI Agent》。 主讲嘉宾 鲁亚东,微软研究院 AI Frontiers 实验室高级研究员。研究兴趣主要集中在大型视觉语言模型上,专注于构建能够在图形用户界面

主讲嘉宾 方云浩,本科毕业于浙江大学,硕士毕业于UCSD(苏昊教授),自24年2月起在Nvidia VILA团队实习(陆垚博士、韩松教授)。主要科研方向是大模型相关的1. 推理能力(通过探索提升推理上限: Unleashing the Creative Mind;通过演绎验证获得可靠思维链: Ded