高保真三维资产生成在多个行业中至关重要。尽管近期的三维预训练模型在生成逼真内容方面表现出强大能力,但大多数模型基于diffusionmodels,并采用“两阶段”流程:先生成几何结构,再合成外观。这种解耦式设计常导致几何与纹理的不对齐,以及较高的计算成本。

论文:UniLat3D:Geometry-Appearance Unified Latents for Single-Stage 3D Generation

链接:https://arxiv.org/abs/2509.25079

代码:https://github.com/UniLat3D/UniLat3D

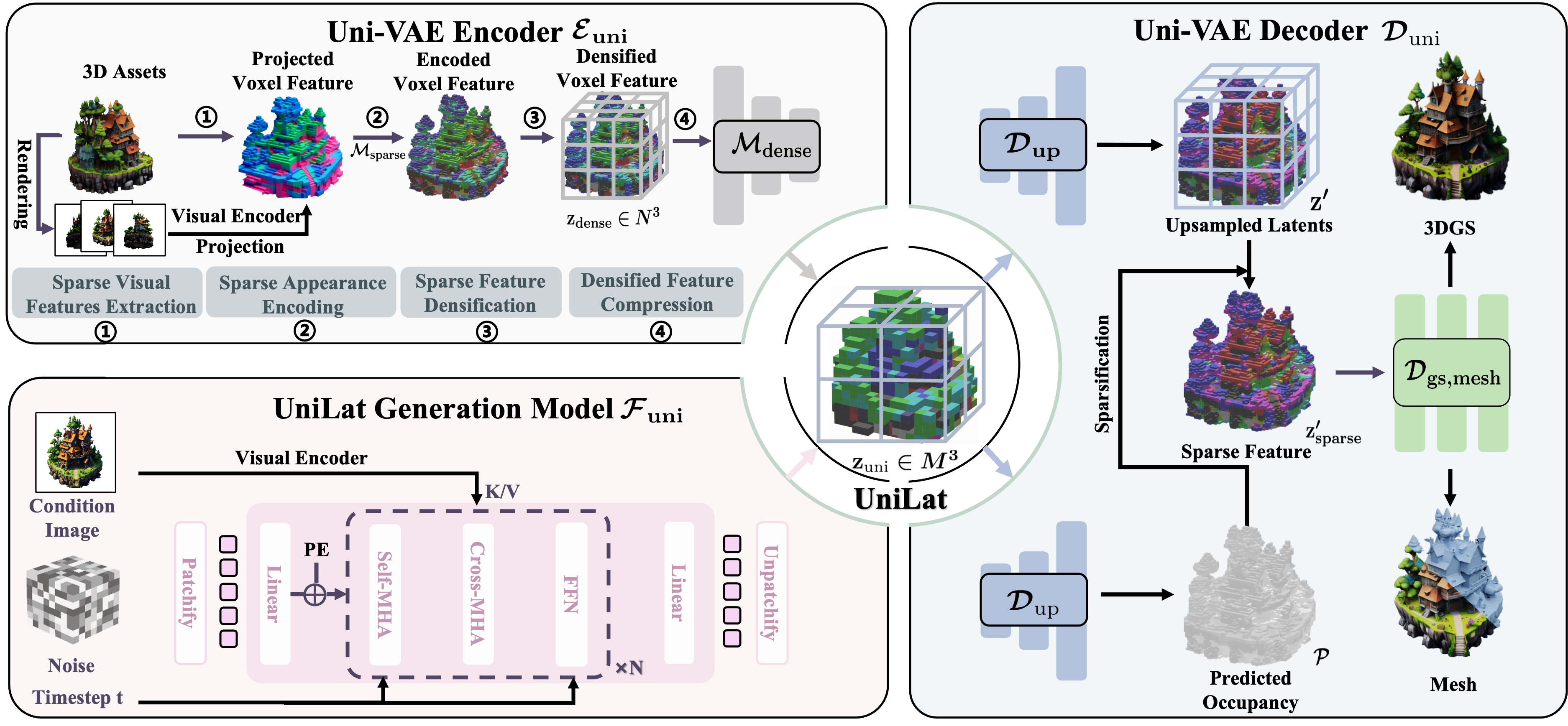

本文提出 UniLat3D —— 一种在单一潜空间中同时编码几何与外观信息的统一框架,实现了直接的单阶段生成。我们的核心贡献是几何–外观统一VAE(Uni-VAE),它将高分辨率的稀疏特征压缩为紧凑的潜在表示——UniLat。UniLat 将结构信息与视觉信息整合为一个密集的低分辨率latent,可高效解码为多种3D representation,如 3DGS与mesh。

基于这一统一表示,我们训练了一个单一的flow-matching model,可将Gaussian Noise直接映射到 UniLat,从而消除冗余的生成阶段。仅依托公开数据集训练的 UniLat3D,能够在数秒内从单张图像生成高质量的三维资产,在外观逼真度与几何精度方面均实现了显著提升。

11月1日(周二)晚8点,青稞Talk 第86期,华中科技大学&华为联培博士生吴官骏,将直播分享《UniLat3D:几秒生成高保真 3D,几何–外观统一VAE的单阶段 3D 生成框架》。

分享嘉宾

吴官骏,华中科技大学&华为联培三年级博士生,博士生导师为王兴刚教授,本科就读于华科计算机学院并辅修经济学。他曾有字节、商汤、华为的实习经历;谷歌学术引用1000+,开源项目在Github 获得stars 3k+。他于CVPR/3DV等国际顶级会议/期刊发表论文5篇,并担任SiggraphAsia/NeurIPS/ICLR/CVPR/IJCV/TCVG等国际顶级会议/期刊的审稿人。他的研究兴趣主要为3D/4D重建与生成。

主题提纲

UniLat3D:几秒生成高保真 3D,几何–外观统一VAE的单阶段 3D 生成框架

1、基于 Diffusion Models 等架构的 3D 生成范式

2、UniLat3D 架构:从两阶段到一体化

- 几何外观统一潜在表示(UniLat)

- 单一流匹配模型(flow-matching model)的训练

3、3D 生成范式的未来研究探讨

4、AMA (Ask Me Anything)环节

直播时间

11月1日(周二)20:00 - 21:00

如何观看

Talk 将在青稞社区【视频号:青稞AI、Bilibili:青稞AI】上进行直播,欢迎观看~

同时,嘉宾已经入驻青稞社区·知识星球,想要提问交流的朋友可以加入星球!