多模态空间智能不仅要求机器理解任意相机视角下的现实世界,更要求其具备从任意相机方位创造世界的能力。然而,当前的视觉与生成模型大多仅隐式地感知相机几何,或将理解与生成任务割裂开来。

新加坡南洋理工大学、商汤科技、密西根大学和马普所的研究者们联手提出了一种全新的范式——将“相机几何”破译为一种“语言”,并引入“与相机共思”(Thinking with Camera)的理念。本篇工作已被收录为 ICLR 2026 高分论文!!!

论文:Thinking with Camera: A Unified Multimodal Model for Camera-Centric Understanding and Generation

链接:https://arxiv.org/abs/2510.08673

代码:https://github.com/KangLiao929/Puffin

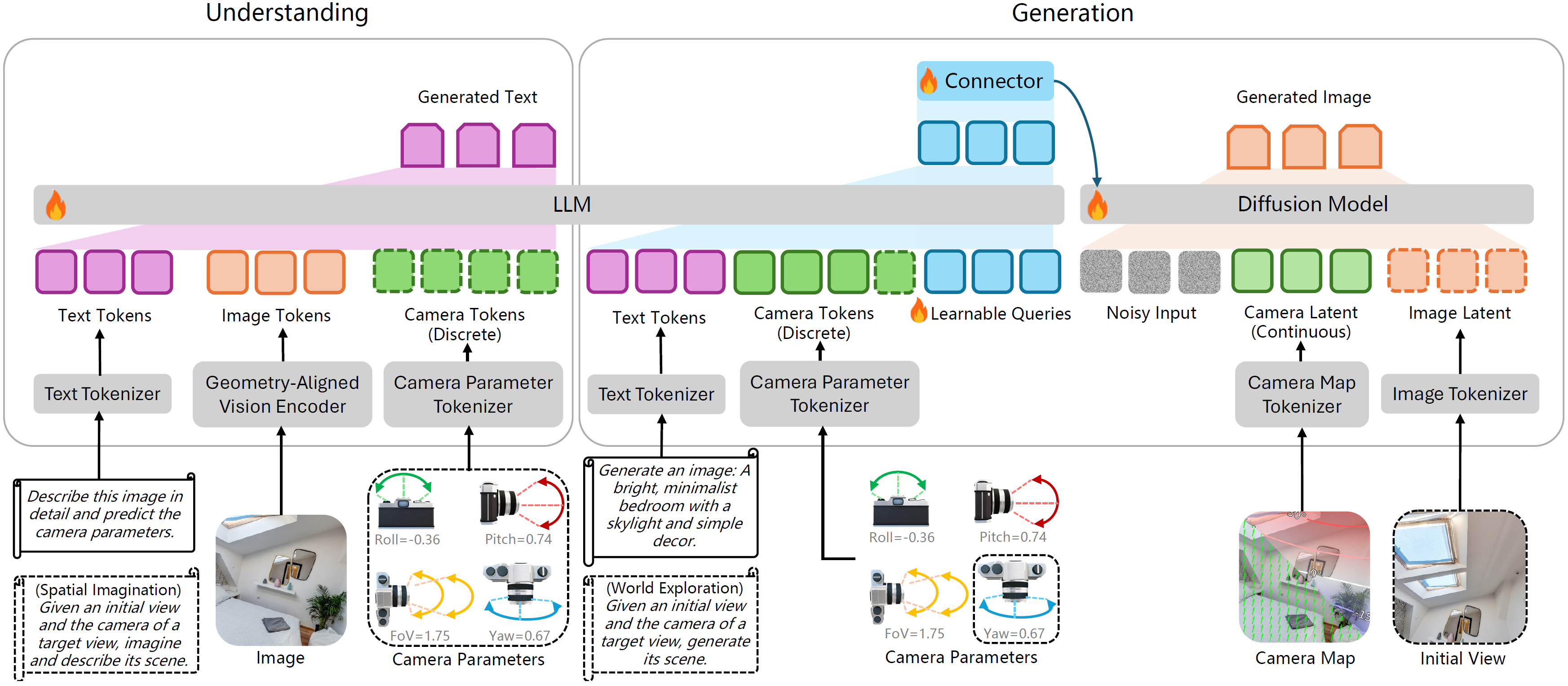

基于这一设想,研究者们进一步提出了Puffin架构:一个能够执行“以相机为中心”的理解与生成统一多模态大模型。Puffin 将自回归推理与扩散建模相结合,使其能够精准预测相机几何、根据指定位姿可控生成世界,并进行鲁棒的空间推理。

此外,该工作开源了 Puffin-4M 数据集,包含 400 万组涵盖海量场景与相机参数的“视觉-语言-相机”三元组。通过精心设计的指令微调,Puffin 还能够支持世界探索、空间想象及摄影指导等多种跨视角、交互式应用。

数据集:https://huggingface.co/datasets/KangLiao/Puffin-4M

这项工作迈出了构建“相机中心化世界模型”的关键一步,实现了感知、推理与生成等多模态任务在显式相机表征下的高度统一。

4月7日(周二)晚8点,青稞Talk 第118期,新加坡南洋理工大学 MMLab 与 S-Lab 博士后研究员廖康,将直播分享《Puffin: 统一多模态空间智能大模型——从任意视角理解和生成世界》。

分享嘉宾

廖康,新加坡南洋理工大学 MMLab 与 S-Lab 博士后研究员。 他于北京交通大学信息科学研究所获得博士学位,期间曾赴德国马克斯·普朗克计算机科学研究所担任访问学者。相关研究成果已发表至国际顶级期刊和会议如CVPR/ICCV/ECCV/ICLR/NeurIPS/ICRA/TPAMI等。此外,他受邀担任 CVPR、NeurIPS 等国际学术顶会的领域主席(Area Chair)。他目前的研究方向包括统一多模态模型、空间智能以及世界模型。

主题提纲

Puffin: 统一多模态空间智能大模型——从任意视角理解和生成世界

1、“以相机为中心”理念在空间智能和世界模型的必要性

2、Puffin架构统一“以相机为中心”的多模态理解和生成任务

3、“与相机共思”空间思维链消除模态鸿沟

4、Puffin-4M“视觉-语言-相机”三元组数据集的构建和拓展

5、指令微调进一步延伸Puffin架构在跨视角、可交互场景中的应用

6、工作局限性和未来研究探讨

直播时间

4月7日(周二)20:00 - 21:00