作者:Sonata,清华大学 计算机科学与技术博士在读原文:https://zhuanlan.zhihu.com/p/2022547604903339697

这里是一些最近做机器人研究产生的的个人看法。具体内容难免存在局限和疏漏,也可能和主流观点并不相同,欢迎友好讨论和指正。

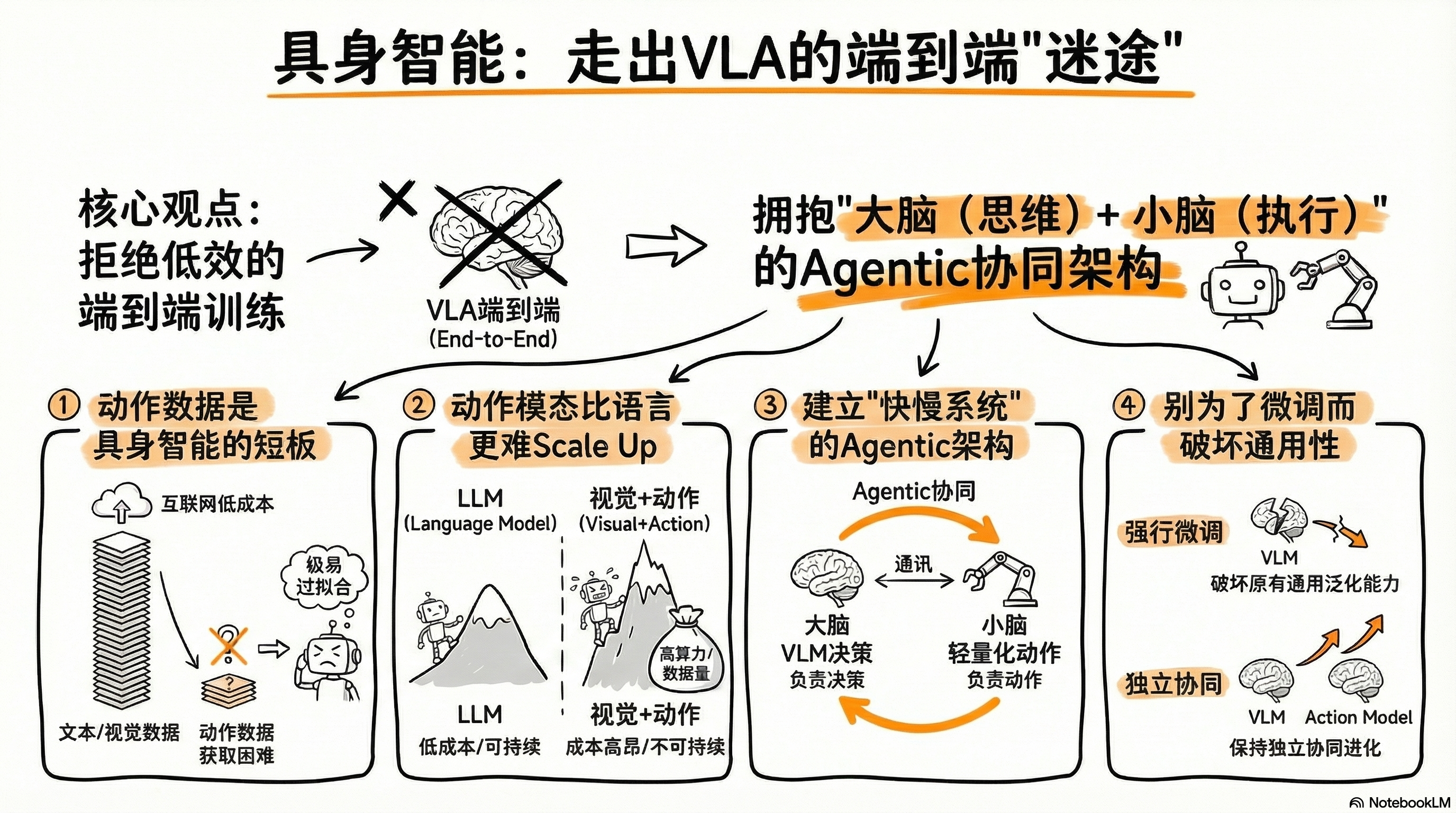

VLA很火热,但也很稚嫩

目前的VLA研究热度很高,最近还火起来了VAM,但不管是哪种范式,他们都是一种尝试端到端去解决具身智能任务的方式:给定视觉和语言作为输入,监督动作输出。

但是无论用什么预训练模型(VLM还是Video Model),无论生成范式是什么(Diffusion还是AR),我们都必须直面一个重要的问题,就是动作模态的失配,即可用的动作数据远小于视觉和文本数据。

AI的训练也存在木桶效应,动作模态的缺失是木桶的最短板,我们无法找到足量的视觉文本数据与对应的动作进行匹配,导致VLA整体训练数据的缺乏。

而在缺乏数据的情况下,对预训练模型进行微调,会让模型过拟合到训练数据上,失去原本的通用性和泛化性。

现在常用的VLA benchmark(LIBERO、CALVIN、SimplerEnv、RoboTwin 2.0)等,任务数量和多样性都非常欠缺,在这些任务上的学习基本都会导致模型过拟合,并且大家为了刷点,会主动让模型去过拟合这个环境。但这些任务其实本身都很简单,换一个人来遥操,成功率基本是100%。

也就是说,在无论要不要过拟合的情况下,目前VLA做这些事情的能力都是远不及人类预期的,更不要说让VLA落地到开放场景,进入家庭、工厂、医院等,去做真正困难的任务。

目前大部分机器人厂家还是在展示自己解决某一项高难任务的能力,无论是叠衣服还是系鞋带还是穿针引线,但说白了,任何单一任务只要采集的够多,总是能被AI解决,甚至可以借助RL或者DAgger来进一步强化能力,这就是数据科学的魅力。

敢展示自己泛化性的厂家很少,敢展示的基本也是拍摄具有未来感的demo(例如某些明星北美Robotics公司),真正能落地使用,达到他们宣称效果的压根就没有,也没有哪个具身智能公司真的敢拿着自己的VLA算法和机器人打包出售。

当然宇树不是这样,他们能出售优秀的机器人硬件和locomotion算法,但他们在春晚舞台上的表演压根和VLA就没有关系。

VLA没那么好Scaling Up,数据是必然的痛点

但其实喷VLA的现状不是我想表达的点,以前的VLM也垃圾过,也没有泛化性过,但VLM还是成功了,并且告诉了研究者们the bitter lesson:一切对通用能力的恐惧都来源于数据不足。

于是许多来自VLM领域的研究者,或者没吃上VLM这波红利的研究者们,立刻就盯上了具身智能这个领域,试图在机器人场景下用相同的经验复刻VLM的成功。

这其实也是我观察到的一个现象:现在宣称自己做VLA的或者说具身智能的,几乎都不是控制背景出身,而都是来自AI的某些夕阳领域。例如很多CV人、3D人都选择将研究目标转向了具身智能。

然而或许他们还是对机器人控制问题缺乏敬畏之心:作为AGI的终极目标,它没有那么容易被解决。

现在的VLA其实想讲的就是这样一个故事:我参考VLM领域的成功,用相似的方式去建模问题,将动作视为一个和视觉、语言等价的模态,用自回归或扩散的方式来生成它。VLM成功的核心是scaling law,所以我们机器人领域也要验证scaling law。

我们要采集足够数量和多样性的含动作模态的开放世界数据,用相同的方式造出VLA。似乎有VLM的珠玉在前,VLA就是一个被顺手解决的问题。很理想主义,但同时也困难重重,在我眼里是几乎不可能达成的目标。

语言这种人类思维的低维投影,表征是token,相对容易被建模,scaling law也被反复验证,但是视觉数据就存在问题,因为视觉数据的表征是像素(或者VAE latent),更加稀疏,要训练出相同能力的生成模型,往往需要数十倍甚至百倍于LLM的数据。

而动作模态呢?在没有一种对动作模态的优良表征的情况下,用原生的EE pose来进行训练,同样在时间维度存在稀疏性,可能需要的数据量并不小于语言。

但很可惜,互联网上存在大量的视觉语言数据任君采撷,可机器人数据不是让人去说话,也不是让人去拍视频,无法从互联网这一资料库上低成本大量获取;同时机器人也不是汽车,不能让用户先开着一辆不会自动驾驶的汽车,收集大量数据来训练自动驾驶算法,你做不到卖给用户一个铁疙瘩,让用户在开放场景帮你采数据。

说白了,机器人数据采集的成本是极度高昂且无法避免的,更不要提每个厂家还有自己的机器人本体设计,他们有不同的性能参数,数据无法通用。现在业界往往考虑使用UMI或者人类数据来缓解这一问题,但也仅仅只是缓解,所有的采集成本依旧必须由机器人厂家承担,做不到像VLM数据或者自驾数据一样,每天都有大量人类自发上传。

对数据的需求更大,同时数据的获取又更困难,我们真的可以用VLM的方式来解决VLA问题吗? 目前世界上的VLA数据存量很有限,放在VLM数据面前,只能算是一个小的子领域。

现在全世界的VLA数据集加在一起,也无法制作出一个好用的智能家务机器人,依旧有大量的开放世界场景无法处理,同时又面临着异构本体、传感器噪声、电机精确度等来自其他学科的问题,这些误差将会级联起来,对VLA模型提出根本性挑战。

很遗憾的是,资本对机器人领域的信心不是无限的,当增长速度或表现不及预期,资本很有可能会撤走,届时这套采集数据的工作模式将变得更加困难。

VLA现在面临很多很多的问题,例如泛化性不足,精确度不足,推理速度慢,闭环控制间隔大,错误修正能力不足,记忆能力欠缺,长程规划能力欠缺等,而这一群房间里的大象,所有的解决方案被总结成了一个铁律:造数据,没有什么比拥有海量的数据更令人安心。

在我眼里,现在VLA这套训练范式是一个过于朴素的设计,它直接挪用了VLM的预训练权重和学习方式,只是想加数据来解决问题。造数据固然是好的,但是别忘了,GPT之所以成功,也是先有了这种decoder-only的Transformer建模方式和良好的Tokenizer,才有了后来大语言模型的成功;

同样在图像领域,也是先有Diffusion打败了GAN、VAE等生成范式,才有现在的研究盛况。没有合适的建模方式,只会事倍功半,例如dLLM和自回归图像生成,他们在数据量足够大的时候能够体现出一定的能力,却始终做不到最顶尖。

我们一定需要一种最合适的表征和学习VLA数据的方式,然后才能考虑去scale up这个东西,否则可能1倍数据能做到的事情,你要花10倍的数据和算力,到那时候可能资本早就抛弃了你。

有时候我多少能理解那些创业公司发布的一个又一个炫酷的demo,在外行人眼里仿佛机器人进入人类家庭就是三五年以内的事,这些是给资本市场的强心剂,但同时也是泡沫的鼓吹者,机遇与风险并存,大家都在赌现在透支能力所换来的投资能够帮助我们真正的做出可用的机器人。在这一问题面前,每个人都没有十足的把握。

Agentic Policy可能才是未来

对于如何解决机器人智能控制的问题,我有一些个人的观点。我们不妨回头看看VLA的初心:因为VLM很强,所以我要把它在我的子领域上微调,做成一个专家大模型。

遗憾的是,这种微调是破坏性的,为了一点专家能力,让模型丢失了大量原本的能力,而这一问题大家想做的解决方案就是我刚刚说的加数据继续调。但是,既然VLM这么厉害,对它的修改就是在破坏它,我们又何必去破坏它呢?

思考决策和具体执行,真的非要做成端到端的吗? 就像人脑有大脑和小脑,一个控制思考,一个控制平衡,甚至你的神经系统能不经过你的大脑执行反射动作,说明在人类这一架构中,思考和执行是可以分开的。如果将人类身体上每一根肌肉用多大的力这件事都交给大脑去执行,那大脑可能早就烧坏了。

我们不妨让VLM作为机器人的大脑,将语言理解、长程思考、任务决策等全部交给VLM,此时可以在机器人的视觉语言数据上进行微调做联合训练,但无需使用动作数据。

同时,下游使用一个快系统来进行动作的执行,此时可以脱离大脑,使用小模型、强化学习等方式对快系统进行快速迭代,在没有大脑的时候,也能完成一些基本的动作。大

脑和小脑之间,用特定的token或者latent进行沟通,类似于一些指令或者技能,这本身也契合当今agent的思想。有很多东西可以作为这种做法的支撑,例如人类的生物学结构、当今VLM agents的发展趋势、对大量已有的无动作数据的利用等。

值得一提的是,在这种范式下,机器人将成为VLM的下游领域,是VLM技能的一部分,是给现有的大模型大脑赋予身体的工作。我旗帜鲜明的反对部分人设想中的去采集大量机器人数据来端到端构建VLA,数据丰富到可以丢掉预训练VLM或者Video Model,用自己的数据从头训练AGI。

我认为这种设想是一种对资源的浪费,资本等不起,人类更等不起;这更不是构建AGI的道路,顶多可以造出一个家务机器人或者工业机器人,也很难想象这玩意的成本能低到取代人类。

有一些早期的工作在这条路上做过尝试,例如VoxPoser等。Figure AI等公司也尝试开发具有快慢系统的人形机器人控制算法,甚至他们还搞出来一个System 0。当然快慢系统这个概念用的比较多,例如pi0的架构就觉得自己的VLM backbone是慢系统,action expert是快系统,但pi0依旧是端到端训练,并不符合我所支持的范式。

在我看来,Agentic的具身智能才是未来,VLM Agent和机器人研究必须是紧密结合、协同进化的合作关系,而不是独立或者只用预训练权重的关系。虽然Agentic的研究目前效果谈不上好,并且研究数量相比起VLA也少很多,但在现今的benchmark面前,这种体系确实存在劣势。

在我看来,这是一个很有潜力的方向,但它一方面需要VLM服务商加入足量的机器人数据进行训练,让模型知道自己可以执行动作;另一方面需要下游设计很好的表征接收方式和到动作的映射方式,肯定不会是让LLM写python code去执行动作的方式。

人形机器人领域一个可能的早期例子是text to motion,然后用tracking policy去追踪动作,这种两阶段的方式能够兼顾文本理解能力和动作质量,但是人类的motion作为中间表征还是太显式、太细节、也不够通用。

做我自己

作为一个机器人领域的研究者,我期待我能真正为机器人的精准灵巧控制策略作出贡献,而不是去端到端的scale up一个all-in-one模型。我不需要我的工作能够理解语言、长程规划、拆分任务、独立思考、也不会想去取代目前如日中天的VLM;

相反的,我应该是VLM最好的用户,是大模型的赛博义体,VLM告诉我怎么动,无需知道为什么。这可能是我作为一个微不足道的从业者,在这个具身智能浪潮下被VLA等热点技术裹挟着向前的时代,最后的一点固执和倔强吧。

想到哪里写到哪里,写的比较乱,文笔也不是很好,希望有把我的想法表达清楚。非常欢迎从业者和研究者一起讨论,提出不同的观点,甚至分享一些支撑VLA继续发展的定量证据。

站在人类科学的最前沿,没有神来告诉我们是非对错,我们所有人都是赌徒,为自己相信的事情而奋斗,才是最值得歌颂的事情。