作者:Yuwei Niu

应该是从去年做完WISE 开始,碰到我的朋友都以为我是做生成出身的,但其实我从最开始做科研就是沿着CLIP LLaVA的经典多模态理解路线,并且我心中也一直更喜欢多模态理解多一些。

然而,近一年以来,似乎社区的热度在多模态方面始终更倾向于生成(GPT-Image, Nanobanana, Sora, SeeDance....)我跟很多朋友聊天,大家很多都觉得多模态理解这个问题已经基本被solve了,范式非常固定,没有继续做下去的空间了。

确实过去两年,多模态大模型发展得极快,图像问答、文档理解、视频描述、视觉推理、GUI agent,越来越多的任务变成了现在模型理所当然的能力,作为LLM的“附加能力”,视觉似乎已经可以满足我们的要求。

但如果不只看今天的 benchmark 表现,而是看它距离真实世界智能系统还有多远,我仍然认为当前的多模态理解处在一个相对早期的阶段。很多模型已经能够看懂一张图、回答一个视频问题、完成一段图文对话,但这离真正意义上的世界理解仍有很长距离。

因为真实世界并不是一组静态图片,也不是几秒钟裁剪好的 benchmark 视频,更不是用户一次性抛来的多模态输入。真实世界是连续流动的、物理展开的、跨时间积累的,也是需要被记住、被检索、被判断、被行动的。

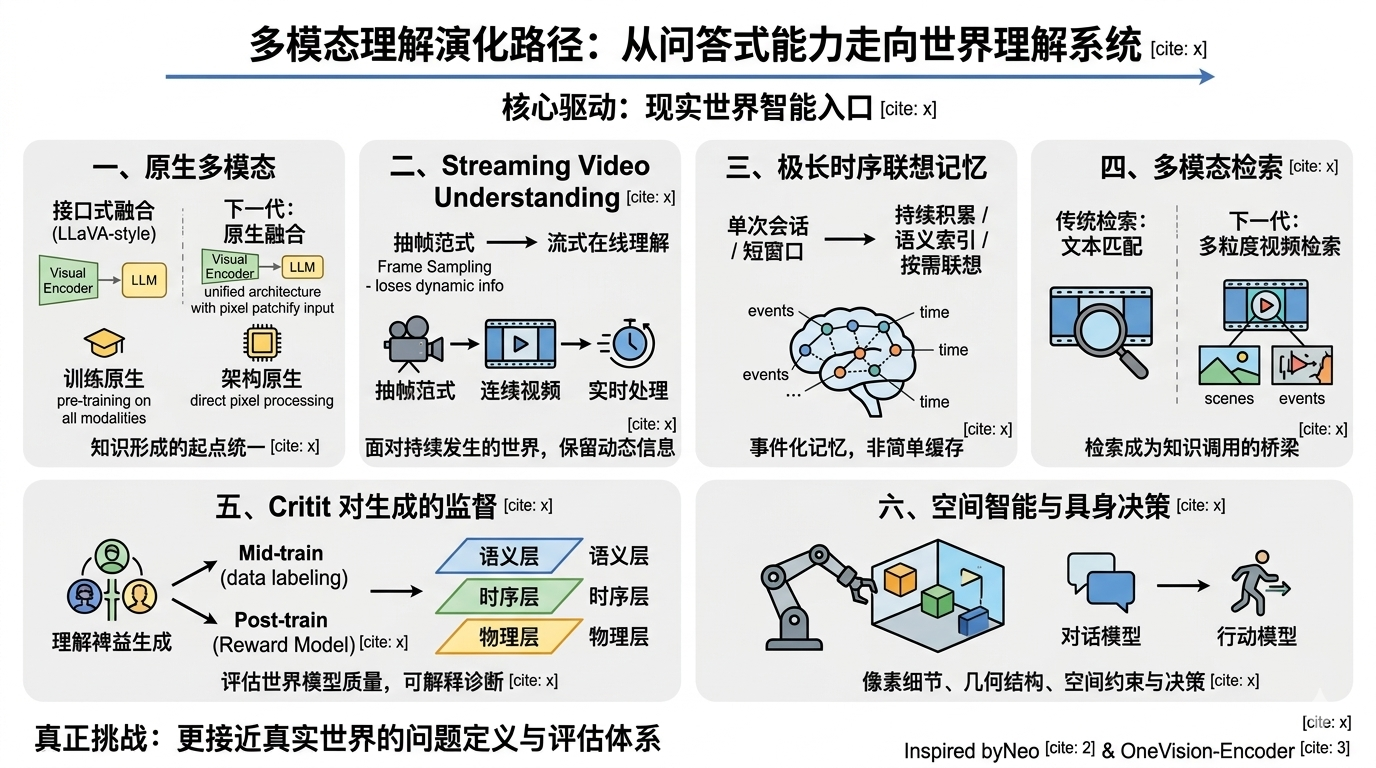

因此,多模态理解的未来,不应仅仅被理解为“模型看图更准了、看视频更强了”,而应被理解为某种“演化”:它会从静态、离线、问答式能力,逐渐走向 动态、在线、具备 长期记忆 、能够参与决策并与其他 智能体 协作的世界理解系统。从这个角度看,会有许多令我无比兴奋的方向乃至未来的可能性。

一、原生多模态:下一代能力的真正起点

回看过去一轮多模态发展的代表性路径,LLaVA 范式无疑是一个关键节点。它证明了一件非常重要的事:一个已经具备强大语言能力的模型,只要接入视觉编码器,并通过相对少量的指令数据做对齐,就可以获得非常可观的图像理解和多模态对话能力。

这种范式工程上高效、效果上显著,也极大推动了多模态能力的普及。

但 LLaVA 式路径更像是一种“接口式融合”——语言模型依旧是核心,视觉更多是以外接模块的方式进入系统。它确实解决了很多问题,但很难解决所有问题。

因为它的本质仍然是:先由一个视觉编码器提取视觉特征,再把这些特征映射到语言模型可以理解的 token 空间中。模型学会了“如何把视觉信息当作语言信息理解”,但未必真正学会了 “如何以视觉方式形成世界知识”。

这也是为什么,未来多模态理解的第一条主线,必然是走向原生多模态。这里的“原生”,至少有两个层面。

第一个层面是训练上的原生。也就是说,在预训练阶段就把图像、视频、音频等模态纳入统一建模,而不是先训练一个纯语言模型,再在后期通过适配和对齐去补视觉。

只有在知识形成的起点就让多模态信号共同参与,模型才有可能在底层表征上建立更自然的跨模态概念。换句话说,视觉不再只是语言模型的“附加功能”,而是模型理解世界的信号源。

第二个层面是架构上的原生。更激进的未来路线甚至可能会逐步弱化乃至去除独立的 visual encoder,不再把视觉理解预先封装成高级语义特征后再交给语言模型,而是直接把像素 patchify,把视觉 token 作为统一模型的原生输入,让模型自己在统一架构中学习从像素中抽取纹理、边界、对象、关系、运动与语义。

这种思路并不只是结构上的简化,而是范式上的转换:模型不再是在“读取已提好的类语言的视觉摘要”,而是在“理解视觉”。这也是我们近期Neo系列所在尝试的事情(Neo系列近期将会上新,欢迎大家关注~)。

诚然,目前的范式已经可以解决很多问题,但是很难以可以解决全部问题,我个人心中偏见认为原生多模态才可能真正支撑 现实世界的streaming video understanding、空间智能、物理一致性判断等场景。原生多模态并不只是“更优雅的实现方式”,它很可能是后续一系列关键能力的起点。

当然,这条路并不容易。直接从 patch 级别统一建模视觉,会带来巨大的计算负担;不同模态的信息密度和 token 结构差异也远大于纯语言;统一架构下的训练稳定性、尺度律是否依旧成立,还有很多问题远未解决。

但方向本身已经很清楚:如果未来的多模态理解要真正进入世界,它不能永远停留在“视觉接口层”的阶段。

二、Streaming video understanding:面向持续发生的世界

如果说原生多模态解决的是“模型如何真正拥有多模态表征”,那么 streaming video understanding 解决的则是另一个更现实的问题:模型如何面对一个不断发生、不会暂停的世界。

今天很多视频理解系统,本质上仍建立在“抽帧”范式之上。视频被视为一系列采样出来的关键帧,然后通过图像理解、时间聚合和语言推理来完成任务。

这个思路在很多 benchmark 上是有效的,也足以支撑视频问答、长视频摘要、动作识别等大量任务。但它的边界同样明显:抽帧可以保留语义,却常常损失最关键的动态信息。(BTW,非常推荐 LMMs-Lab 的 OneVision-Encoder 利用Codec编码替代了传统的视频抽帧方式。)

视频不是一组图片,而是一段正在发生的现实。真实世界中的大量重要信息,并不体现在某一帧“长什么样”,而体现在某个对象如何移动、两个物体如何接触、一个状态如何演化、一个动作如何展开。

速度、加速度、碰撞、遮挡变化、力的传递、微小动作偏差、因果顺序,这些都属于典型的“动态信息”。一旦退化成稀疏帧采样,模型可能仍然知道“画面中有一个人、一张桌子、一个杯子”,却不再真正知道“杯子是如何被碰倒的”“动作是故意为之还是意外发生”。

这也意味着,未来的视频理解绝不只是“在长视频里抽更多帧”,而是要让模型具备流式、在线、持续的理解能力。这在现实场景中尤其重要。Vision Pro、AR 眼镜、机器人、自动驾驶、工业监控、医疗监测,这些都不是离线视频文件处理问题,而是持续接收传感器流的问题。输入不是一个几分钟的视频样本,而是一个近乎永不终止的视觉世界流。

在这种场景下,模型面临的核心问题也随之变化。它不再只是“看完再答” “问时再答”,而是必须在输入到来的同时不断更新内部状态;不再只是离线总结内容,而是要在线判断当前发生了什么、接下来可能发生什么、哪些信息需要保留、哪些变化值得报警、哪些事件构成更高层语义单元。这种能力更接近一种“实时世界建模”而不是传统意义上的“视频理解”。(换种角度,这也许是Video Understanding的Openclaw)

Streaming video understanding 的难点,首先在于它要求模型同时处理短时物理连续性和长时语义状态。模型既要理解几百毫秒内的动作变化,也要维护几分钟、几小时甚至更久的情境状态。

其次,它要求增量式推理和记忆压缩。现实中不可能每来一帧就把全部历史重新计算一遍,因此模型必须具备事件边界检测、状态摘要、局部重算、长期记忆写入等机制。

最后,它还要满足实时性约束——这意味着“理解能力”不能无限靠堆算力来获得,而必须在系统设计上重新思考延迟、记忆、压缩和决策之间的平衡。

未来的视频理解模型,面对的将不再是“一段视频”,而是“一个持续展开的世界”。而一旦这个转变真正发生,多模态理解也会第一次真正从媒体内容分析,走向现实环境感知。

三、极长时序的联想记忆:多模态模型的事件化记忆

如上所述,如果模型持续接收视频流,那么下一步必然不是“每一秒都重新开始理解”,而是把过去发生过的事情记忆下来。那么更进一步的问题就是:模型能否在足够长的时间尺度上,形成类似人类的长期视觉记忆?

这是一个比“长视频理解”更深的问题。长视频理解通常处理的是几十分钟到几小时的连续输入,而现实世界中的很多重要问题,实际上跨越的是数天、数周甚至更长时间。真正走向个人设备、空间计算和具身系统的多模态模型,不可能只活在单次会话和短时窗口里;它必须具备一种持续积累经验、压缩经历、建立索引、按需联想的能力。

关键不是把所有历史帧都塞进更长的 context window。那样做既不现实,也不智能。人类的长期记忆也不是按原始像素逐帧回放的,而是高度事件化、语义化和关系化的。我们记住的不是过去三天每一秒钟视网膜接收到了什么,而是“昨天把钥匙放在玄关柜子上”“前天和同事在会议室白板前讨论过某个方案”“上周那个实验第一次出问题之前温度曲线有异常”。也就是说,长期多模态记忆的核心,不是更大的缓存,而是更好的事件化记忆、语义索引与联想召回。

这个能力一旦落地,场景会非常丰富。最典型的,是未来的 AR 设备与个人智能助手。设想一个用户佩戴 Vision Pro 一类的设备连续工作和生活数天之后,可以自然地发问:“我前天在办公室最后一次看到那本红色封面的《安娜卡列尼娜》是在什么时候?”“上周和老师讨论白板方案时,他最终让我们修改的两个点是什么?”“这几天我每天喝完咖啡后,大概多长时间开始分心?”“那个快递我到底是放在书房了还是客厅了?”这些问题都不是传统多模态问答能解决的,它们要求模型横跨数日的视觉流,追踪人物、物体、地点和事件,自动建立索引,并进行跨场景的语义关联。再比如家庭机器人场景。

一个真正有用的陪伴或辅助机器人,必须知道老人这几天是否按时吃药、最近行动路线是否异常、某个物品通常放在哪里、某种行为模式是否发生变化。这已经不是简单的监控录像回放,而是带有语义抽取、模式联想和因果回溯能力的长期多模态记忆系统。

某种意义上,未来的多模态理解会逐渐变得像陪伴人类成长一样。它不只是感知世界,还要陪世界一起度过时间。它必须知道哪些东西值得记住,哪些值得遗忘,哪些要写入长期记忆成为commen sense,哪些只保留短期状态,哪些需要在未来某个问题出现时被重新激活。长期记忆机制,很可能会成为多模态系统从 demo 走向现实助手的桥梁。

四、多模态检索:新一代的搜索引擎?

一旦模型开始持续感知并形成记忆,下一个核心问题就变成:这些记忆如何被有效调用?一个模型如果能看懂,却不能有效索引、存储、检索和重组这些理解结果,那么它的价值就会被局限在“即时回答”里,而无法成为长期可复用的信息。

这正是多模态检索,尤其是视频检索,我认为在未来会变得极其重要的原因。

在过去几十年的互联网中,文本始终是最主要的知识载体,因此检索系统本质上主要服务于网页、文档和文本内容。搜索引擎做的是文本匹配与排序,推荐系统理解的是用户对文本和结构化内容的偏好。但随着带宽提升、设备普及和生成技术发展,视频正在越来越快地成为主要的信息传递形式。

教程、会议、直播、课堂、第一视角记录、工作流演示、社交表达、真实世界采集,都会越来越多地沉淀为视频。未来互联网的重要知识不一定写在网页里,而可能藏在无数小时的视频流中。(这点inspired by the podcast form elon musk)

这时,多模态理解的价值就不再只是“帮用户描述视频讲了什么”,而是要回答更具体也更困难的问题:什么操作具体发生在什么视频的第几分钟?有没有其他视频展示了相似的物理过程?我刚刚看到的这段画面是否和上周你记载的某个片段相似?用户说的“像昨天那种情况”,系统能不能从多天的视觉记录中找到对应实例?用《雨爱》作为BGM的五条悟大战宿傩的视频的第几秒五条悟使用出了 “赫”。

相比图文检索,视频检索天然更难,因为视频不仅有内容,还有时间;不仅有对象,还有动作;不仅有语义,还有事件展开;不仅有画面,还有语音、字幕、环境声和上下文状态。一个真正强的视频检索系统,不只是给整段视频打一个标签,而是要建立多粒度索引:镜头级、片段级、事件级、视频级,并且支持跨模态查询——用户可以用文字找视频、用视频找视频、用过去某段经历找当前问题的相似案例。

从这个角度看,多模态检索会成为连接“理解能力”和“知识系统”的关键桥梁。未来最有价值的多模态系统,不一定是最会即时描述的,而是最会记住和找回的。因为很多时候,我们真正需要的并不是一句解释,而是一次精准的召回:把过去发生过、但已经离开当前上下文的信息重新带回来。

五、多模态理解作为 critic:监督世界模型与视觉生成

做统一多模态理解与生成的我们总想找到理解裨益生成,生成裨益理解;而我始终有一个不一定正确的观点,

其实我认为理解裨益生成很早就发生了,现在多模态生成的发展很大程度上来自于多模态理解的强大:在mid-train阶段中多模态理解模型的数据打标,在post-train阶段多模态理解模型作为reward model。

现在视觉生成已经在持续快速发展。越来越多的模型能够从文本、图像、动作条件出发,生成高保真的动态视觉内容,但是,目前来看,视觉生成的短板区域,往往就是视觉理解的短板区域。

比如说尽管视觉生成已经能在视觉风格和短时局部一致性上给人很强的真实感,但只要把要求提高到物理和时序层面,问题就会迅速暴露。物体会突然穿模,接触关系会不稳定,动作前后逻辑会断裂,角色身份会漂移,遮挡关系会出错,因果顺序会混乱。

这恰恰是多模态理解的不足之处。作为生成模型的数据来源之一(这句话其实说出来有点搞笑xs)以及后训练的critic,多模态生成的强大必然要依靠一个更加强大的多模态理解模型。

有一个让我非常印象深刻的例子,去年的十月份sora2出来的时候,我对当时市面上比较强大的模型包括seedance、veo3、seedance都进行了一次评测,任务非常简单,描绘一个小男孩进店买花然后出店关门。但是所有模型都卡在了这个男孩最后转身出店关门的这个动作上,更为令我瞠目结舌的是,当我使用视觉理解模型judge结果的时候,所有模型都会认为这个视频没有任何问题。

同样的问题也出现在图片评分上,最近我在重塑WISE,大概在下下周会推出来新一版的WISE(并不是什么WISE2.0,只是一个Verified的版本),需要使用开源的VLM对模型生成的图片进行打分,但是,从Qwen2.5到Qwen3.5的200B以下的模型,我全部遍历了一遍,最后发现只有Qwen3.5-122B-A10B达到了一个还算可用的程度...

这正说明,目前的多模态理解在作为视觉的critic方面,尚且没有达成我们的要求。

我认为这样的 critic 至少需要工作在三个层面上。

- 第一个是语义层,判断生成内容是否符合文本指令、场景设定和对象关系。

- 第二个是时序层,判断事件是否自然展开,动作是否连续,状态转移是否合理,物体与事件是否存储于“记忆”中。

- 第三个是物理层,判断重力、惯性、碰撞、支撑、接触、遮挡、可动性等是否符合基本世界规律。

最后,依据着语义、时序、物理,模型能否预测未来发生时间的可能性。

更进一步,一个足够强的 critic 不应该只是一个输出分数的判卷器,而应该成为一个可解释的诊断器。它不仅说“这段视频不好”,还要指出“哪里不好”:是哪一秒的接触关系不成立、哪个对象在跨帧跟踪中失去身份一致性、哪一段动作违反了运动学常识、哪一个场景切换打破了隐含因果。这样一来,多模态理解模型就可以进一步帮助视频生成的训练和优化方向。

可以说,如果世界模型负责“想象世界”,那么多模态理解模型将负责“评估世界”。而一个真正懂物理、懂时序、懂交互的视频理解 critic,也许会成为未来世界模型质量跃迁的必要前提。

六、空间智能与具身决策:从聊天模型走向行动模型

从今天的多模态模型表现来看,一个越来越明显的矛盾正在出现:模型在语义理解和对话层面进步很快,但在像素级细节、几何结构、空间约束和动作决策层面,能力仍然相对薄弱。

这种局限主要来自三个层面。首先是架构层面。多数模型依赖 CLIP 或类似视觉 encoder 提供视觉表征,而这类模块本身更偏向高层语义压缩与跨模态对齐,并不以保留精细像素信息、三维几何结构或空间可操作性为目标。

其次是数据层面。当前训练数据大多由图像或视频与文本描述配对构成,监督信号强调的是“场景可以被如何描述”,而不是“场景在空间中如何组织、物体如何相互约束、动作如何在物理世界中实现”。

最后是目标层面。大多数 MLLM 的优化目标,本质上仍是在多模态条件下拟合语言分布,因此模型最终学到的,是一种“在看到图像时更会说”的能力,而不是一种“在看到世界时更会行动”的能力。

当然,我并不是这个领域的专家,因此便不过多空想未来应该如何。

七、真正的挑战:更接近真实世界的问题定义与评估

如果把这些趋势放在一起看,就会发现,多模态理解未来的关键并不是现有bench继续上升,而是研究目标本身正在被重写。

过去的多模态评测主要围绕图像问答、短视频理解、OCR、图表推理和多模态知识问答展开。这些任务当然重要,也为能力发展提供了必要牵引。但它们仍然更多是“静态样本—离线回答”的范式。

而未来真正重要的任务,可能会是:连续数小时甚至数天的 streaming 理解、跨场景的长期记忆检索、物理一致性判断、三维空间推理、具身行动决策、协同感知与状态维护。

这意味着,未来多模态理解面临的最大瓶颈之一,也许不是模型本身,而是我们尚未建立与真实世界任务充分对齐的评价体系。

一个模型可能在 benchmark 上很强,却无法在真实世界中持续追踪一个对象三天;可能能答对物理选择题,却无法识别一段生成视频哪里违反接触规律;可能能描述房间布局,却无法支持机器人安全地完成一次抓取。

评测方式决定优化方向,而如果目标始终停留在“更像考试题”,模型就很难真正走向“更像世界”。

与此同时,另一个经常被忽视的问题是记忆管理。现实世界输入是无限流,而任何系统的计算、带宽和上下文都是有限的。

因此,未来多模态理解的核心能力之一,必然是“知道什么该记、什么该忘、什么该压缩、什么该索引、什么该在什么时候被重新召回”。而如何评估这种能力设计出一个较为合理且general的场景,也是对我们的考验。

毕竟,定义问题始终是科研最重要的能力之一。

最后的最后

除此之外,还有很多很多可能性,比如multi-agent的感知协作、交互式理解等等,总而言之,言而总之,如果说大语言模型的未来已被无数人坚信是数字世界的生产力变革,我认为,多模态世界的未来将会是现实世界的智能入口。