作者:sheriyuo

https://zhuanlan.zhihu.com/p/2011084180654671820

从工程上看,我们通常把 RLHF 当成“在 \pi_{\rm ref} 附近,通过偏好信号或显式 reward 优化策略”的交互学习:

先收集偏好/评分数据,再通过某种带 KL 正则项的 policy 优化得到最终模型 \pi_\theta 。但对于 RLHF 在高维、有限样本下的泛化能力,我们其实并没有一个清晰、可操作的理解。

论文:Towards a Theoretical Understanding to the Generalization of RLHF

链接:https://arxiv.org/abs/2601.16403

本文把 RLHF 目标写成可参数化的后验 Boltzmann 策略并在“线性 reward + 特征覆盖”框架下,采用算法稳定性(uniform stability)作为主工具,逐步刻画了经验最优点与梯度法解的子最优性(suboptimality)与泛化率。

对任意 prompt x 与 action a ,定义线性特征映射 \phi(x,a)\in\mathbb{R}^d 和线性 reward 家族

给定 \pi_{\rm ref},对任意策略 \pi(\cdot|x) 定义局部目标

整体目标为 J(\pi)=\mathbb{E}_{x}[f_\pi(x)]。DPO 提出 RLHF 的目标函数对应的全局最优策略存在闭式解(Posterior Boltzmann form)

这一命题在文中作为基础事实并用于后续参数化分析。在此基础上,引入参数化的策略族

并把目标变为对参数 \boldsymbol\theta 的优化J(\pi_{\boldsymbol\theta})

。为了可证,论文引入了若干常规假设:

假设 1(特征有界):对所有 (x,a) 有 \|\phi(x,a)\|\le C 。这是对特征空间的常规有界性约束,用以控制常数项并保证若干 Lipschitz / 光滑量界存在。

假设 2(线性 reward):存在真实参数 \boldsymbol\theta^*\in\mathbb{R}^d, \|\boldsymbol\theta^*\|\le D,使得真实 reward 为 r(x,a)=\langle\boldsymbol\theta^*,\phi(x,a)\rangle 。该假设把 reward 归约为参数线性模型,并保证 \boldsymbol\theta^* 在参数化类中是可表示的。

假设 3(充分覆盖 / 正定性):对于任意 \boldsymbol\theta,x,存在 \sigma>0 使得

几何上,该条件保证期望协方差矩阵正定,从而经验协方差在样本数足够大时能覆盖整个特征空间——这为唯一性结果与参数可辨识性提供基础。基于该假设,论文证明了“经验驻点等于真实参数”的唯一性结论(见下)。

假设 5(特征覆盖的弱化形式 / 残余分解):对任意 prompt x 与 action a,存在一个关于训练集 \boldsymbol S 的投影表示

其中\boldsymbol V_{\boldsymbol S}(\boldsymbol\theta_{\boldsymbol S}^*)是经验方差矩阵的列空间投影算子,残差项满足\sup_{x,a}\|r_{\boldsymbol S}(x,a)\|\le \epsilon_n 并且随样本数 n 收敛,\epsilon_n\leq \mathcal O(n^{-1}), n\to \infty 。

该假设捕捉了“随着 prompt 集合多样性增加,经验列空间近似覆盖真实特征空间”的直觉,并把不能完全覆盖的部分用可控残差分离出来。

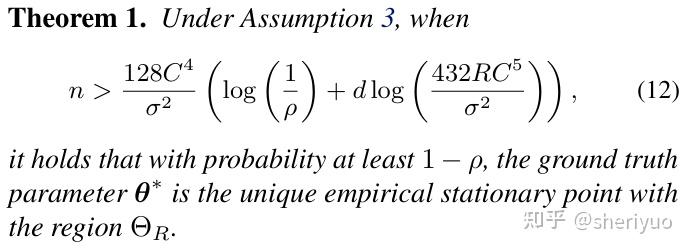

在这些设定下,论文的第一个主要结论是:在充分覆盖(假设 3)条件下,且样本数 n 足够大时,经验驻点 \Theta_R := \{\boldsymbol\theta \in \mathbb R^d \mid \|\boldsymbol\theta\| \leq R \} 唯一且等于真实参数 \boldsymbol\theta^*。

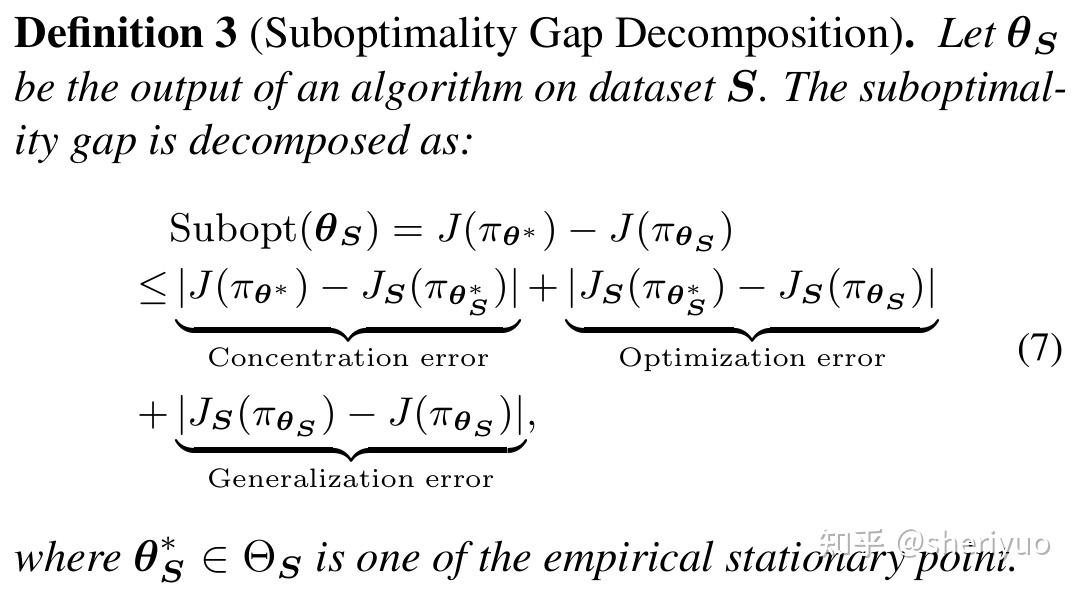

接下来要把“泛化误差/子最优性”分解清楚,并引入算法稳定性来控制泛化项。文章采用如下的子最优性分解思路

这里 J_{\boldsymbol S}表示经验目标(在样本集 \boldsymbol S 上的平均), \boldsymbol\theta_{\boldsymbol S}^* 表示经验最优参数。三项分别对应:泛化误差、经验优化误差与经验项偏差。关键在于上界第一项(泛化误差)和第二项(优化误差),而第三项可以由数据浓缩直接控制。

引理 12(梯度的显式表达):在线性 reward 参数化和后验 Boltzmann 策略假设下,经验目标的梯度有封闭形式

其中

这个表达式的证明直接由对数似然梯度规则与线性化 reward 得到(把 r(x,a) 用 \langle\boldsymbol \theta^*,\phi\rangle 代入并展开期望与方差项),并体现了“梯度指向 \boldsymbol \theta^*-\boldsymbol \theta 被方差矩阵调制”的直观几何结构。该等式在之后所有关于梯度下降/上升收敛性的分析中被反复使用。

基于上述表达,论文给出经验最优点的稳定性估计,用假设 5 将任意特征分解为“可被经验列空间表示的部分 + 残差”,从而把单点替换对梯度与目标值的影响拆成两部分。主流程为

(1) 证明在该分解下,经验驻点与替换后驻点之间的差可由矩阵条件数

与残差范数 r_ {\boldsymbol S} 控制;

(2) 使用 Lipschitz / 平滑界,把该点差转化为目标函数值的变化;

(3) 利用矩阵浓缩和残差随 n 收敛的假设,得到稳定系数随样本数以 O(n^{-1/2}) 缩减的量级。组合经典的“稳定性→泛化”引理,便得到经验最优点的泛化界。

定理 2(经验最优点的稳定性与泛化率):在假设 1, 2, 5 下,经验最优点 {\boldsymbol{\theta}_{\boldsymbol{S}}^*} 的算法稳定系数满足(文中给出精确常数的上界形式),并由此导出以高概率成立的泛化误差界

更进一步结合经验项与集中不等式,论文证明了经验最优点关于真实最优的子最优性同样为 \widetilde{O}(n^{-1/2})。

上面的结论已经把“经验最优解在样本丰富时能泛化”的主张用定量界给出。

接着论文将视角从静态经验解扩展到实际训练中经常使用的梯度型算法,并给出 GA(Gradient Ascent)与 SGA(Stochastic Gradient Ascent)的子最优性界。

核心思路是先通过光滑性得到梯度范数随迭代 T 的衰减(通过 telescoping sum),再用稳定性框架控制从经验到期望的差异,并把优化误差与泛化误差合并。

定理 4(GA / SGA 的子最优性):在假设 1,2,5(以及一些常规步长选择)下,GA 的子最优性满足

而 SGA(带合适衰减步长与随机梯度噪声控制)则满足更弱但也可控的速率

这些速率的直观来源可以分解为:n^{-1/2} 项来自于算法稳定性与数据浓缩,反映样本规模对泛化的主导贡献;而关于 T 的项来自于把梯度范数(或二阶误差)变成函数值差所产生的中间步骤,因而出现了较慢的 T 依赖。

论文最终给出的结论可以总结为:

- Posterior Boltzmann 的参数化下,线性 reward 假设结合特征覆盖,会令经验最优点在样本数 n 足够大时以 \widetilde{O}(n^{-1/2}) 的泛化速率逼近真实最优;

- 在实际用到的 GA/SGA 优化流程中,额外存在随着迭代步数 T 下降的优化项,合并后 GA 的子最优性量级为 \widetilde{O}(T^{-1/4}+n^{-1/2}) ,SGA 为 \widetilde{O}(T^{-1/8}+n^{-1/2});

- 这些精确速率把“数据预算 n” 与 “ 计算预算 T ” 以可比的方式串联起来,为 RLHF 的训练策略设计(例如如何在数据采集与训练迭代之间做权衡、如何选择正则强度与参考策略)提供了理论支撑。

综上所述,该工作把 RLHF 的端到端训练过程在“线性 reward + 特征覆盖”框架下系统化为一套可证的稳定性与收敛分析链条:先用矩阵谱与浓缩保证经验驻点的可辨识性,再用残差分解与稳定性量化泛化,最后将梯度算法的优化动力学嵌入此框架以得到迭代-样本混合收敛率。